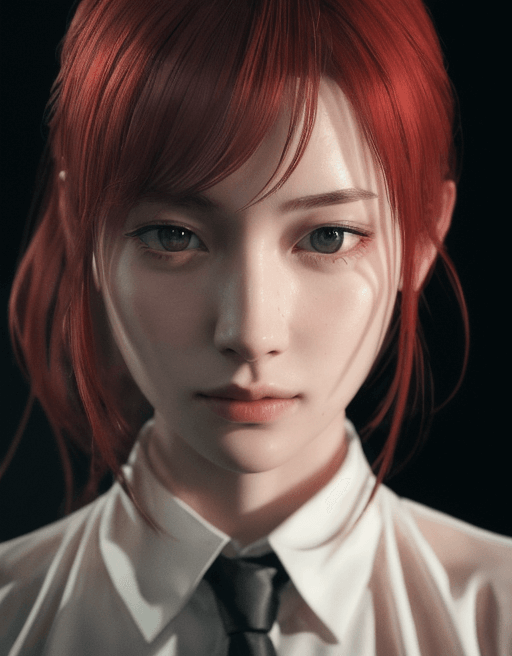

こちらの画像は、Google Colabで立ち上げたStable Diffusionで生成したAI画像です!

Stable Diffusion Web UIは、ChromeやSafariなどのブラウザを通してStable Diffusionを利用することができる、今話題のAI画像生成サービスです。

今回は、その中でも特に使っている人が多いGoogle ColabでStable Diffusion Web UIを立ち上げる方法や使い方について、分かりやすく徹底的に解説していきます!

内容をまとめると…

Google Colabを使えば低スペックPCでもStable Diffusion Web UI(AUTOMATIC1111版)をブラウザから利用できる

Googleドライブ保存方式とそのまま立ち上げ方式の2種類があり、用途に応じて使い分けが必要

有料プランGoogle Colab Pro(月額1,179円)が実質必須で、100コンピューティングユニットの制限に注意

商用利用は基本可能だが、使用するモデルのライセンスを事前に確認する必要がある

きれいな画像を作れるようになっただけで、収益化できずに止まってませんか?

romptn ai では、実際に画像生成AIで稼いでいるプロを講師に招いた完全無料のAIクリエイターセミナーを開催しています。

2時間のオンラインセミナーで、実際に稼いでいる人が使う最新画像生成AIツールや上級者にステップアップするための必須スキルなどの知識面はもちろんのこと、ゼロから収益化を実現するための具体的なロードマップを体験談ベースで詳しく学ぶことができます。

また、豪華な無料参加特典も用意していますので、ぜひご興味を持った方はお気軽に下記のボタンから詳細をチェックしてみてください!

\ 現役の画像生成AIのプロから学べる! /

無料セミナーの詳細をみる- Stable Diffusionとは

- Google Colaboratory(Google Colab)とは

- Google Colaboratoryの注意点

- Google Colaboraoryを使ってStable Diffusion Web UIを立ち上げる方法

- Google ColaboratoryでのStable Diffusionの使い方!

- Google Colab版Stable Diffusionでエラーが出た場合の対処法

- Google Colab版Stable Diffusionで生成した画像の保存先の設定

- Google Colab版Stable Diffusionにモデルを追加する方法

- Google Colab版Stable Diffusionに拡張機能を導入する方法

- Google Colab版Stable DiffusionでLoRAを利用する方法

- Google Colab版Stable DiffusionでVAEを利用する方法

- Google Colabでファインチューニングはできるのか?

- Stable Diffusionで画像生成する際におすすめの呪文(プロンプト)

- Stable Diffusionで画像生成をする時におすすめのストレージ容量

- まとめ

Stable Diffusionとは

画像生成AIには、DALL・EやMidjourneyも有名ですが、Stable Diffusionは2022年8月にパブリックリリースでソースやモデルなどが無償公開されたことで話題になっています。気になる方はこちらをお読みください。

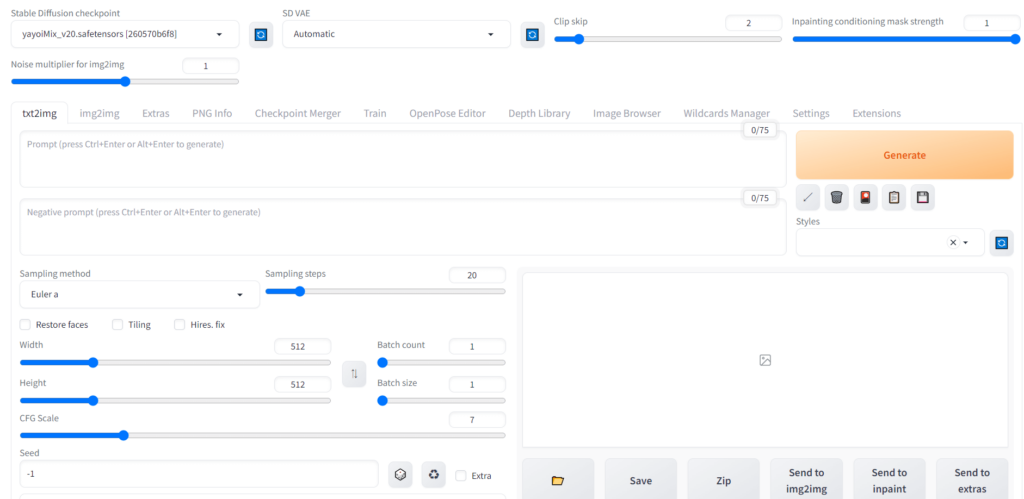

以下の画像は、Stable Diffusionの操作画面になります。GUI(アイコンなどをクリックしたりタッチしたりすること)で呪文(プロンプト)やネガティブプロンプト、モデルなどを簡単に操作でき、さらに画像を生成することもできます。

また、Stable Diffusionではテキスト(プロンプトやネガティブプロンプト)から画像生成できるだけでなく、既存の画像をテキストで修正することもできます!

※詳しくは、以下の記事を参考にしてください。

Stable Diffusion Web UI(AUTOMATIC1111)とは

Stable Diffusionを利用する環境としてGoogle ColabやPaperSpaceなどの仮想環境・PC上で行うローカル環境などがあります。

その利用環境の中でも、特に【AUTOMATIC1111版】Stable Diffusionが注目を集めているのです。

このAUTOMATIC1111(オートマチックイレブン・イレブン)版Stable Diffusionは、プログラマーのAUTOMATIC1111さんによって開発されました。特徴としては、Gradioライブラリを使用しており、ブラウザを通じて簡単に「Stable Diffusion」を利用できる点が挙げられます。

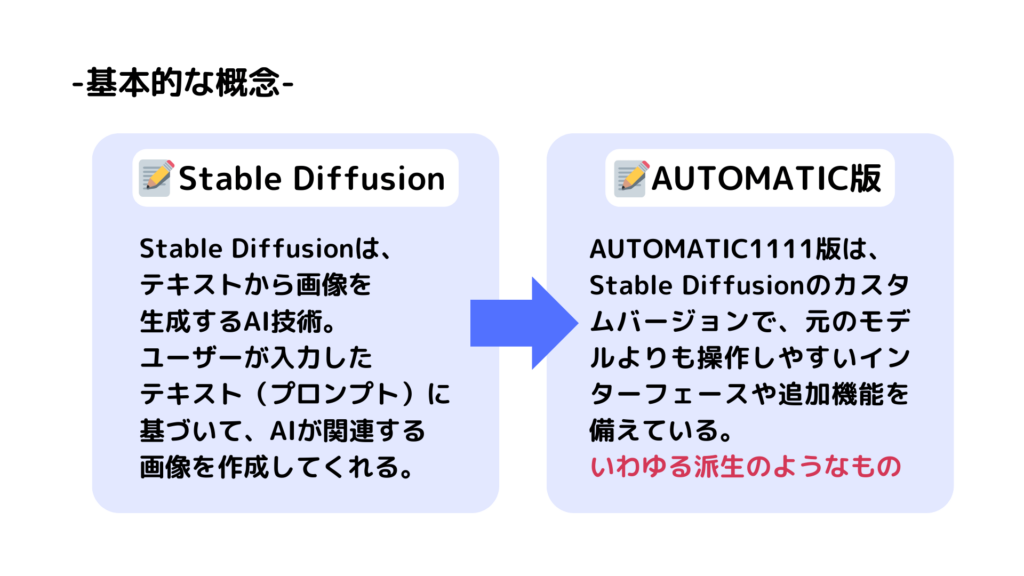

「通常のStable Diffusionとの違いって何?」と思う方もいらっしゃると思いますが、簡単にまとめると以下の図表のようになります!

つまり、AUTOMATIC1111版Stable Diffusionは、通常のStable Diffusionをより簡単な操作性にしつつ、便利な機能を加えたものという認識になります。

1つ注意が必要なのですが、AUTOMATIC1111版Stable DiffusionはGoogle Colabでの利用に制限されています。

Stable Diffusionの著作権や商用利用について

Stable Diffusionは基本的に商用利用可能です。そして、Stable Diffusionを提供している企業は、生成した画像はユーザーが自由に使用して良いとしています。

ただし、使用するモデルによって商用利用できるかが変わりますので、事前にダウンロードページを確認する必要があります。

Stable Diffusionで生成した画像が商用利用できない場合は以下の3つになります。

- 商用利用不可のモデルを使用した場合

- 商用利用不可のモデルをLoraで学習させた場合

- 商用利用不可の画像を読み込んだ場合

Stable Diffusionで画像生成をする際には、商用利用や著作権の知識を身に付けておけば、上手くビジネスに活用することもできます。

きちんとモデルのライセンスや著作権を確認し、トラブルを起こさないように気を付けましょう!

※詳しくは以下の記事に記載してありますので、是非お読みください!

Google Colaboratory(Google Colab)とは

Google Colaboratoryは、Google社が提供している、ブラウザから直接Pythonを記述して実行できるサービスです。Stable DiffusionはPythonで動いているために、Google Colaboratery上で実行ができるということです。

AIで画像生成をするためには、ハイスペックのパソコンが必要になります。しかし、そのような高性能のパソコンを持っていないという方もたくさんいらっしゃいますよね。

そこで、ハイスペックなパソコンを持っていない方でもStable Diffusionが利用できるのがGoogle Colaboratoryです。

Google Colaboratoryの注意点

ここからはGoogle Colaborateryを使う際に気を付けることについて解説していきます!

①Google Colabを無料で利用するのは厳しい

②有料プラン『Google Colab Pro』に入る必要がある

③100コンピューティングユニットの制限がある

④Googleドライブや仮想マシンによって使い心地が異なる

上記の4つについて詳しく解説していきます。

①Google Colabを無料で利用するのは厳しい

Google Colaboratoryでは、高性能なGPUを制限内ではありますが、無料で利用することができます。有料プランである『Google Colab Pro』に申し込むと、さらに良い環境でStable Diffusionを利用することもできます!

先程Google Colaboratoryは無料で利用することができると言いましたが、Stable Diffusionのコードを実行すると以下のような警告が表示される場合があります。

ですので、今後は無料で利用することが難しくなるだろうとされています。

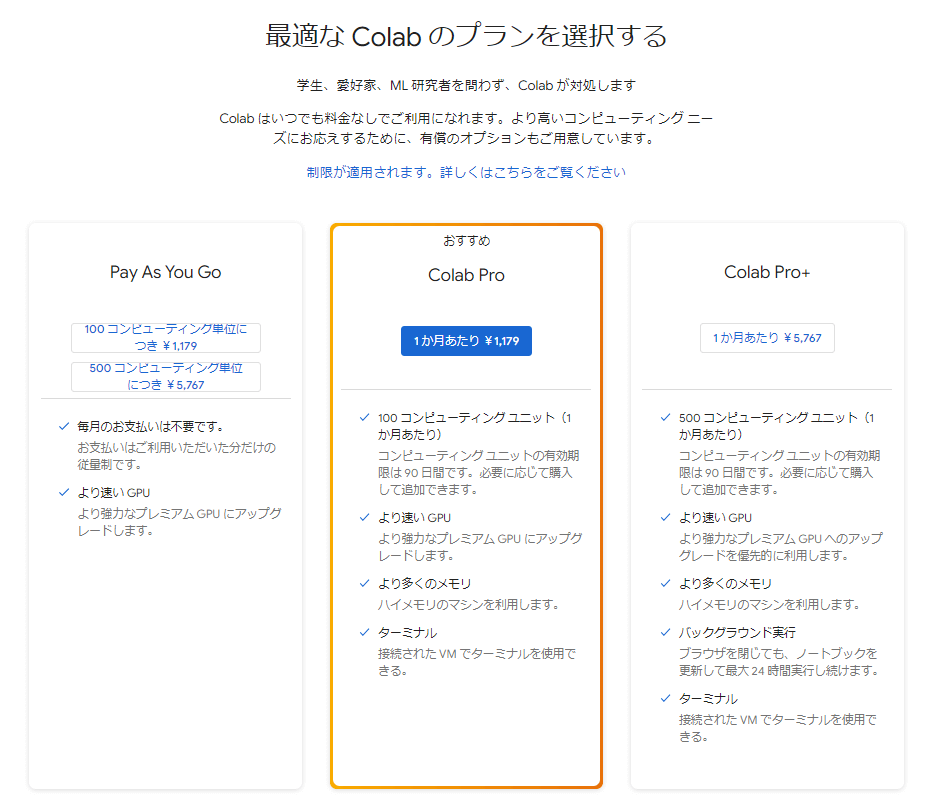

②有料プラン『Google Colab Pro』に入る必要がある

Google ColabでStable Diffusion Web UIを立ち上げて利用するには、有料プラン『Google Colab Pro』に申し込む必要があります。

2024年1月現在では、月額1,179円となっています。

なぜ有料プランに課金したほうが良いかというと、Stable Diffusionの利用者が増加したため、無料版には制限がかかってしまうようになったからです。

制作関係者は『無料版はサポートしないが、有料版は制限を設ける予定はない』と話しています。

ですので、Google ColabでStable Diffusionを立ち上げて使いたい方は、有料プラン『Google Colab Pro』に申し込むことをオススメします。こちらのリンクから購入することができます!

③100コンピューティングユニットの制限がある

有料プラン『Google Colab Pro』に申し込むと、ハイスペックな仮想マシンを利用して、Google Colabのノートブックを実行することができます。

ただし、100コンピューティングユニット以下の制限があるので注意が必要です。

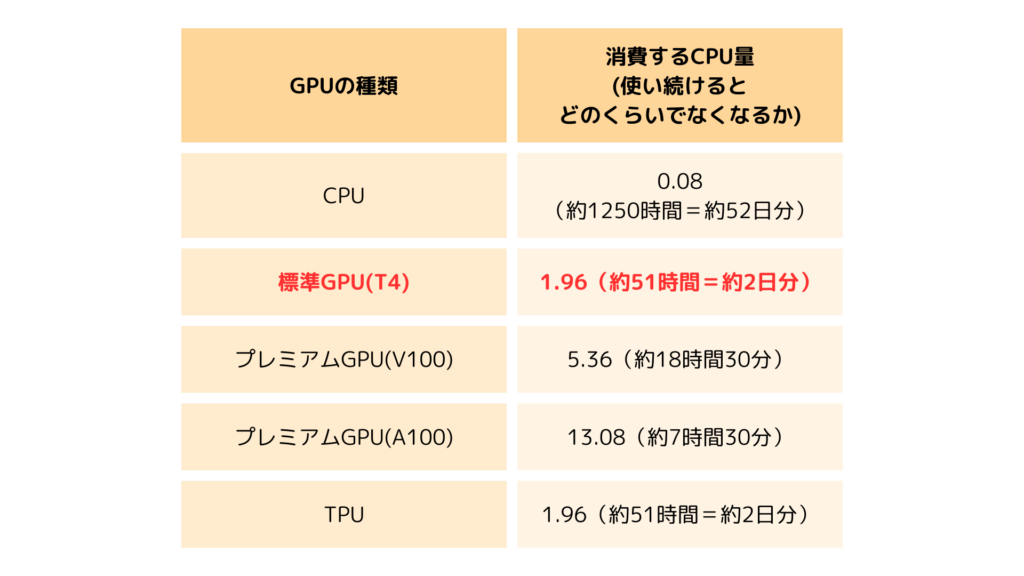

コンピューティングユニット(CPU)は、使用できるリソースの量を表すものです。一般的には、以下が目安とされています。

- CPU:0.08(約1250時間=約52日分)

- 標準GPU(T4):1.96(約51時間=約2日分)

- プレミアムGPU(V100):5.36(約18時間30分)

- プレミアムGPU(A100):13.08(約7時間30分)

- TPU:1.96(約51時間=約2日分)

コンピューティングユニットを使いきると、Stable Diffusionのコードを実行する際に先程ご紹介したような警告が表示されます。

100コンピューティングユニットを使いきっても利用できないことはないのですが、上記のリストを参考にして上手にやりくりしていくと良いでしょう。

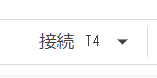

GPUあたりの消費量をチェックする方法

では、自分がいまどのぐらいGPUを消費しているかチェックする方法についてご紹介します。

Google Colabノートブックの右上にある①『GPUの種類』をクリックすると、リソース情報が表示されます。

①「GPUの種類」…T4、A100、V100などの自分がいま使用しているGPUの種類が表示されます。

②「利用可能なコンピューティングユニット数」…現在利用できる残りのコンピューティングユニットの量が表示されます。

③「使用率」…現在使用しているGPUの1時間あたりのコンピューティングユニットの消費量が表示されます。

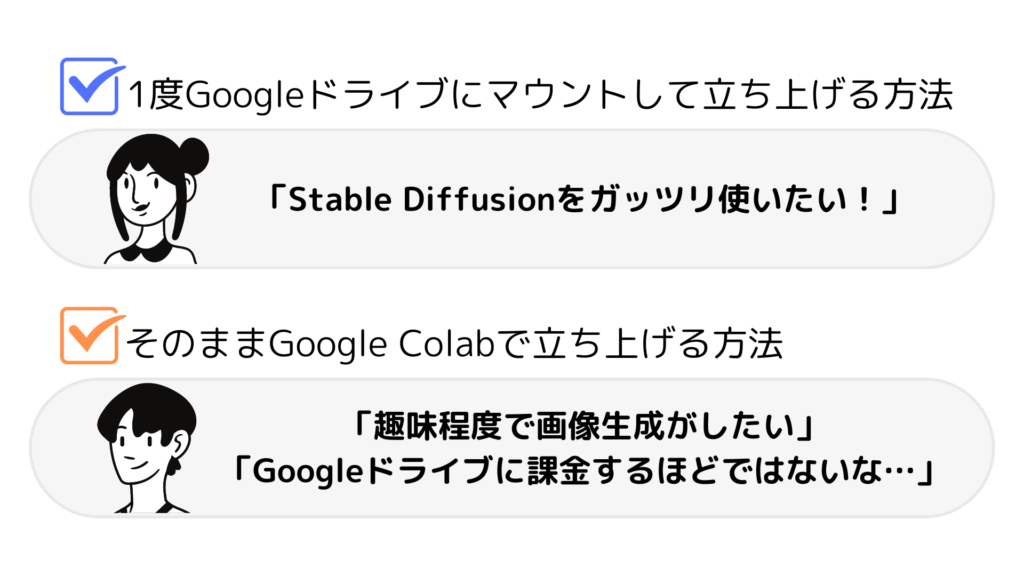

④立ち上げる方法によって使い心地が異なる

Google Colabでの仮想環境でStable Diffusionを立ち上げる方法は、

・そのままGoogle Colaboratoryで立ち上げる方法

・1度Googleドライブにノートブックを保存して永続的に使えるようにして立ち上げる方法

の2種類がありますが、それぞれメリットとデメリットがあります。

| そのまま立ち上げる方法 | Googleドライブに保存して立ち上げる方法 |

|---|---|

| 〇快適で画像生成が速い | 〇データが残る |

| ・セッションが切れることがある | ・無料プランの容量が15GBしかない |

| ・時間制限によりデータが削除されることがある | ・モデルや拡張機能を使いたい場合は有料プランが必要 |

| ・Stable Diffusionを使うたびにインストールが必要 | ・ドライブをマウントして動かすので動作が重い |

表のような特徴がありますので、下記画像を参考にして自分の画像生成方法に合うものを選んでください。

「Stable Diffusionをガッツリ使いたい!」という方は、1度Googleドライブに保存して立ち上げる方法がおすすめです。

「趣味程度で画像生成を楽しみたい」「Googleドライブに課金するほどではないな…」という方は、そのままGoogle Colabで立ち上げる方法をオススメしています!

Google Colaboraoryを使ってStable Diffusion Web UIを立ち上げる方法

続いては、Google Colaboratoryの仮想環境を使ってStable Diffusion Web UIを立ち上げる方法を紹介していきます!

- 1度Googleドライブにノートブックを保存して永続的に使えるようにして立ち上げる方法

- そのままGoogle Colaboratoryで立ち上げる方法

上記の2つの方法について解説していきます。

方法①:1度Googleドライブにノートブックを保存する

この方法でStable Diffusionを立ち上げる時には、『fast-stable-diffusion』を使います。

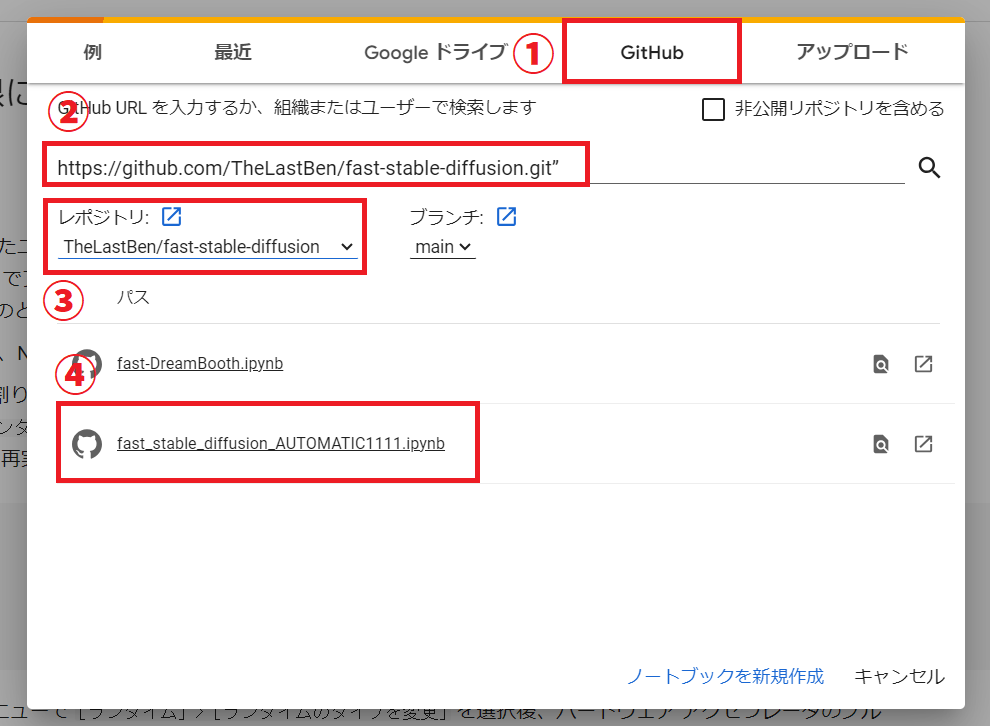

①Google Colabを開いてファイルから“ノートブックを開く”をクリック

②GitHubタブで、“https://github.com/TheLastBen/fast-stable-diffusion.git”を入力

③GPUを有効化する

④ノートブックの上から実行ボタンを押していく。

⑤URLを開くと、立ち上げが完了

①Google Colabを開いてファイルから“ノートブックを開く”をクリック

②GitHubタブで、“https://github.com/TheLastBen/fast-stable-diffusion.git”を入力する

(画像の順番で操作してください!)

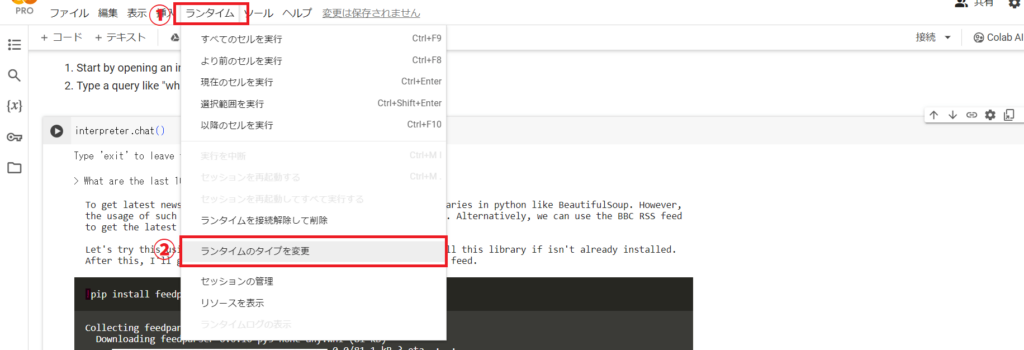

③GPUを有効化する。

ノートブックが開いたら、上部のタブから『ランタイム』を開き「ランタイムのタイプを変更」をクリックしてください。

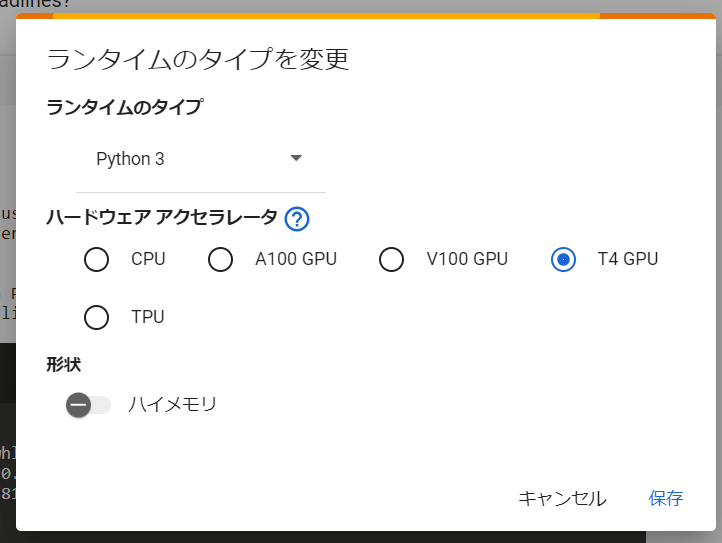

そして、下記画面が表示されたら利用するランタイムを選択して「保存」をクリックします。

どれを使ったらいいか分からないという方は、下記画像を参考にしてください!

V100やA100は1日ですぐ使い切ってしまう可能性があるので、標準GPU(T4)がおすすめです!

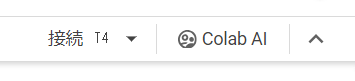

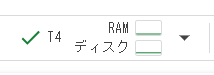

選択できたら、ノートブック右上にある『接続 ○○(GPUの種類)』をクリックします。

接続が完了すると、下記画像のように緑のチェックマークが付きます。

④ノートブックの上から実行ボタンを押していく。

GPUが接続できたら、ノートブックの上から順番に実行ボタンをクリックしていきましょう。

●『Connect Google Drive』

Googleドライブへのアクセス許可を求められるので、“Googleドライブに接続”をクリックしてください。

続いてファイル共有も許可してください。

●『Install/Update AUTOMATIC1111 repo』

●『Requirements』

この2つは特に設定することはないので、そのまま進めてください。

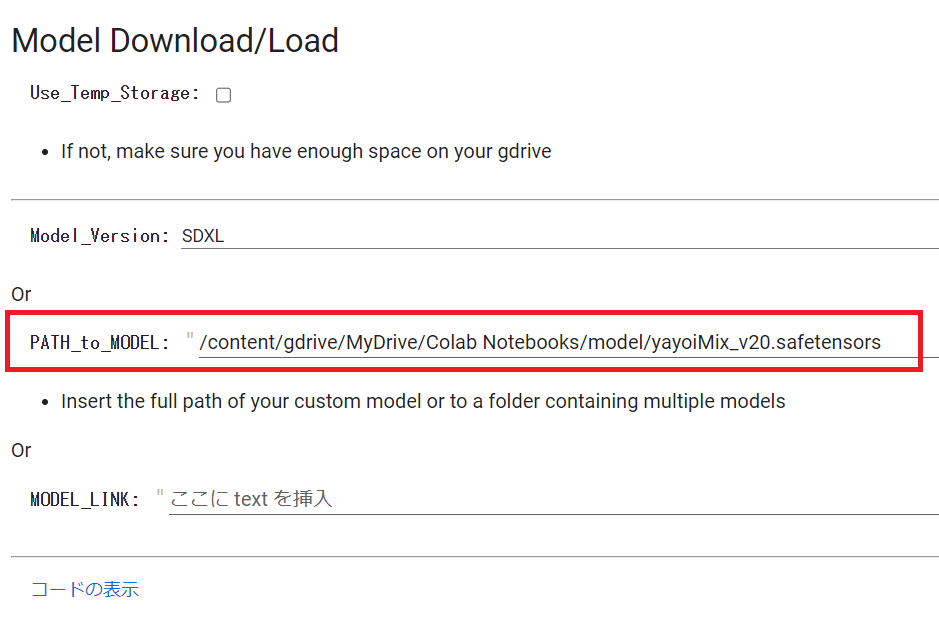

●『Model Download/Load』

ここでは、“yayoi_mix”を使います。

ローカルから保存したモデルのパスコードを入力することで、モデルを追加できます。

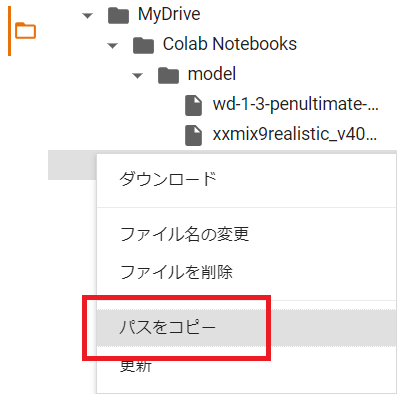

ノートブックの左にあるファイルアイコンをタップし、モデルデータが入っているフォルダを開きます。

使いたいモデル名を右クリックしたら、『パスをコピー』をクリックすることでパスコードをコピーできます!

●『ControlNet』

ControlNetとは、Stable Diffusionで利用できる拡張機能です。

ControlNetをインストールするには21GBもの容量が必要なため、使いたい機能だけ選択して実行ボタンを押しましょう!

※ControlNetについては、以下の記事で解説しています。

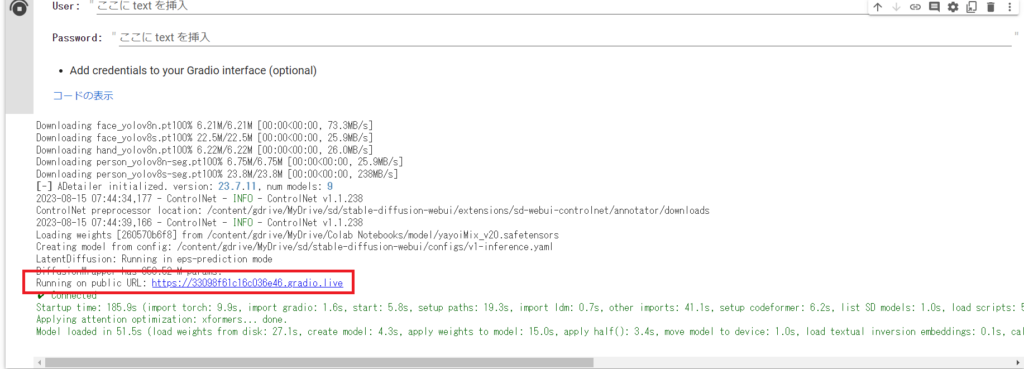

●『Start Stable-Diffusion』

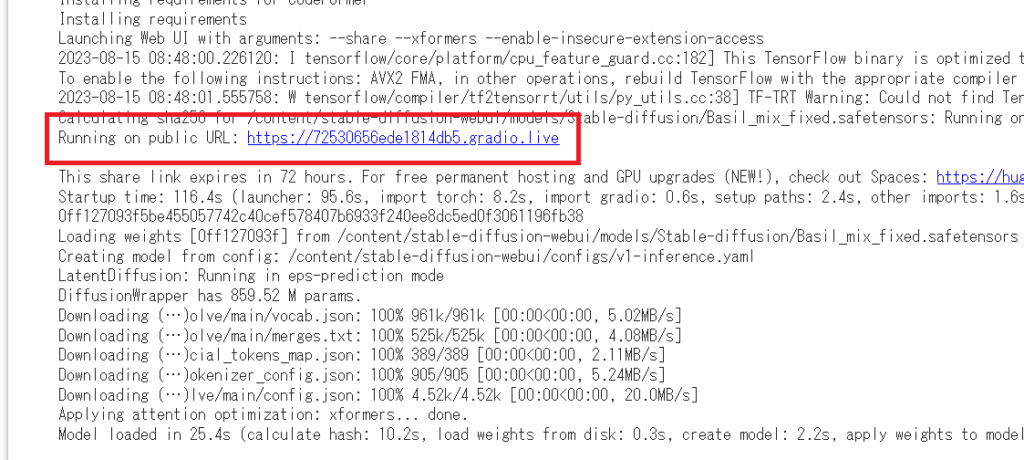

実行すると、最後にURLが表示されます。

このURLにアクセスすることで、立ち上げが完了です!

方法②:そのままGoogle Colaboratoryで立ち上げる方法

続いては、ノートブックを保存せずにそのままGoogle Colaboratoryで立ち上げる方法でStable Diffusionを立ち上げる方法を解説していきます!

①https://colab.research.google.com/drive/1hbTrMEBTgvlNuX3_n2I1FRMopKZV9hvs を開く

②メニューバーの「ランタイム」から『ランタイムのタイプの変更』をクリックし、ハードウェアアクセラレータを“GPU”にする

③ノートブック右上の『接続』をクリック

④書いてあるコードを実行する

⑤URLにアクセスしたら、立ち上げ完了

①下記リンクのノートブックを開く

初心者の方でも立ち上げやすいように、ノートブックを作成していますので、以下のリンク先のものをコピーして使ってください!

②メニューバーの「ランタイム」から『ランタイムのタイプの変更』をクリックし、ハードウェアアクセラレータを“GPU”にする

GPUのタイプは、コンピューティングユニットの消費に影響を及ぼすため、ご自分で選択してください。

快適な画像生成をしたい方は、「A100」がおすすめですが、CPUの消費はかなり早いのでお気を付けください。

設定できたら、『保存』をクリックします。

③ノートブック右上の『接続』をクリック

以下の画像のような表示になれば、ノートブックを実行できる状態になります。

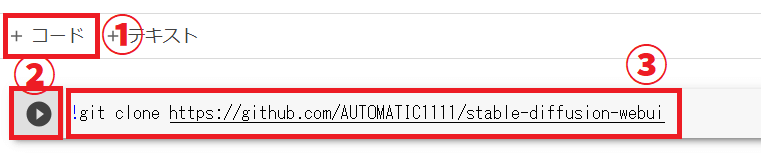

④ここからはコードを実行します。

先程紹介したノートブックに下記コードが記載されていると思いますので、お好きなモデルに変更してお使いください!

!git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

%cd /content/stable-diffusion-webui

!wget https://huggingface.co/nuigurumi/basil_mix/resolve/main/Basil_mix_fixed.safetensors -O /content/stable-diffusion-webui/models/Stable-diffusion/Basil_mix_fixed.safetensors

!wget https://huggingface.co/stabilityai/sd-vae-ft-mse-original/resolve/main/vae-ft-mse-840000-ema-pruned.safetensors -O /content/stable-diffusion-webui/models/VAE/vae-ft-mse-840000-ema-pruned.safetensors

!wget https://huggingface.co/datasets/gsdf/EasyNegative/resolve/main/EasyNegative.safetensors -O /content/stable-diffusion-webui/embeddings/EasyNegative.safetensors

!python launch.py --share --xformers --enable-insecure-extension-access上から

・Stable Diffusion Web UI立ち上げのコード

・モデルの導入コード

・VAE(画像の鮮明度を上げる)の導入コード

・xformers(生成速度を速める)の導入コード

となっています。

青色の部分は、お好きなモデルに変更して使ってください!

・モデルの変更方法は、モデルデータのダウンロードボタンを右クリックして「リンクをコピー」したものを入力してください。(※モデルは複数個導入できます)

実行には少し時間がかかるので、待ちましょう。

※コマンドライン引数の設定について軽く説明します。

| –share | Google ColabでStable Diffusionを利用する時に必要なもの |

| –enable-insecure-extension-access | 拡張機能を利用できるようにするもの |

| –xformers | VRAM(映像をモニター出力することに特化した パーツ“GPU”に搭載されているメモリ)の消費量を抑え、画像生成を高速化するもの |

それ以外も設定できるので、こちらを確認してください。

⑤URLが出てきたら、アクセスする

これでStable Diffusionの立ち上げが完了です!

Google ColaboratoryでのStable Diffusionの使い方!

ここからは、Google Colabの仮想環境で立ち上げたStable Diffusionを使って画像生成をする方法について、実際に生成しながら説明していきます!

基本的に操作するのは、画像の通りです。

以下の操作を最低限行えば、綺麗に画像生成ができます。

- 指示したい英単語を呪文(プロンプト)欄に、生成してほしくない要素を英単語でネガティブプロンプト欄に入力します

- 『Sampling method』は、“DPM++ SDE Karras”にすると綺麗に生成できます

- 最後に『Generate』ボタンを押すと、生成できます!

では、実際に画像を生成してみましょう。ここでは、チャイナドレスを着たAI美女を生成してみます。

プロンプト

1 woman, beautiful, Cheongsamネガティブプロンプト

(low quality, worst quality:1.4), extra arms, extra legs, deformed, mutated, NSFW, ((poorly drawn face)), too many fingers※呪文(プロンプト)については、記事下部で紹介しています。

生成された画像がこちらです!

綺麗なAI美女の画像を生成することができました!以上がGoogle Colabを使って立ち上げたStable Diffusionで画像を生成する方法になります。

Google Colab版Stable Diffusionでエラーが出た場合の対処法

Google Colabを使ってStable Diffusionで画像生成をしている際に、エラーが出ることは多々あります。

頻繁に発生するエラーとその対処法について解説していきます!

エラー①:突然画像が生成できなくなる

Stable Diffusionで画像生成をしている際に、『Something went wrong Connection errored out.』とエラーが出ることがあります。

このエラーは、突然画像生成ができなくなってしまったことが原因です。

●対処法

Stable Diffusionを再起動することで治ります。

エラー②:サーバーの過負荷

Stable Diffusionを無料版のGoogle Colabで立ち上げて使用していると、サーバーが過負荷となってしまうため、先程と同じく『Something went wrong Connection errored out.』というエラーが出る場合があります。

●対処法

①呪文(プロンプト)やネガティブプロンプトをシンプルにする

無料版のGoogle Colabを使う際に、複雑な呪文(プロンプト)を入力するとエラーが発生しやすくなっています。そのため、シンプルな呪文(プロンプト)を入力してみましょう。

②Google Colabの有料プランに加入する

どうしても複雑な呪文(プロンプト)やネガティブプロンプトを入力してハイクオリティな画像生成をしたいという方は、Google Colabの有料プランに加入しましょう。画像生成ができなくなるエラーが発生しなくなるだけでなく、使用できるGPUの種類も増えるため、画像生成のスピードも速くなります。

エラー③:Pythonを起動していない

Stable Diffusionを利用する場合には、Pythonを起動させておく必要があります。

Pythonを起動しないまま、Stable Diffusionを利用している場合は以下のコードを実行してからStable Diffusion Web UIをダウンロードしてください。

%pip install torch==2.0.0+cu118 torchvision==0.15.1+cu118 torchtext torchaudio torchdata==0.6.0 --index-url https://download.pytorch.org/whl/cu118※ほかにもStable Diffusionのエラーが発生する場合があるので、以下の記事を参考にしてください。

Google Colab版Stable Diffusionで生成した画像の保存先の設定

続いて、Google Colabで立ち上げたStable Diffusionで生成した画像を保存する方法について解説していきます!

手順は簡単にまとめると、以下のようになります。

①Google Colabのノートブックを開き、左側の『ファイル』アイコンをクリック

②『ドライブをマウント』をクリック

③Googleドライブへのアクセスを許可するために、『Googleドライブに接続』をクリック

④Googleドライブに接続されたら、左側のファイルフォルダに“drive”というフォルダが表示されたかを確認

⑤画像を生成した後に、以下のコードを実行することで画像を保存できる

# 保存したいフォルダのパス

path = "ここに保存したいフォルダのパスを貼り付ける"

filename = "好きなファイル名"

# 保存

image.save(f"{path}/{filename}")詳しい操作方法は、以下の記事で解説しています!

Google Colab版Stable Diffusionにモデルを追加する方法

Stable Diffusionで画像を生成する場合には、モデルのダウンロードが必要不可欠になってきます。

モデルとは、“AIが学習した画像生成のためのもの”で、“高品質な画像を簡単に生成すること”ができます。モデルには、アニメ系や実写系など得意なジャンルがあるので、自分が生成したい画像のイメージに合ったモデルを使うことで、クオリティの高い画像を生成することができます。

続いては、Google Colabでモデルを追加する方法について解説していきます!

Google Colabでモデルを追加する方法は、以下の2種類あります。

①『Hugging Face』からダウンロードする

②URLからダウンロードする

①『Hugging Face』からダウンロード

『Hugging Face』は、AI関連のコミュニティーサイトになっており、さまざまな情報やモデルが共有されています。

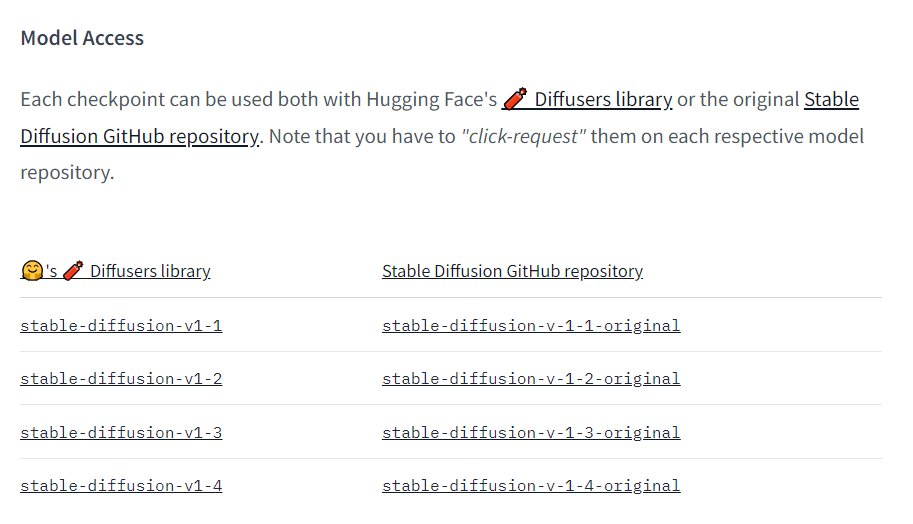

こちらのページで公開されている、Stable Diffusionの公式モデルを例にして解説していきます。

上記画像のように『Model Access』に、公開されているモデルがリストされています。

今回は現時点で最新の“stable-diffusion-v1-4”をダウンロードします。

【モデルのダウンロード方法】

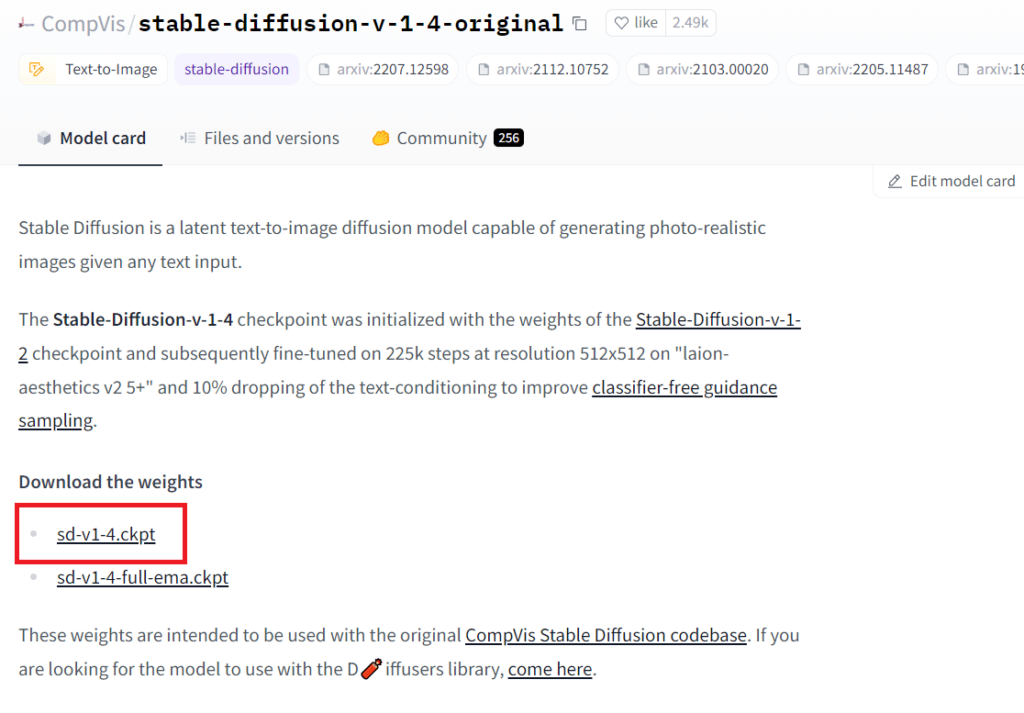

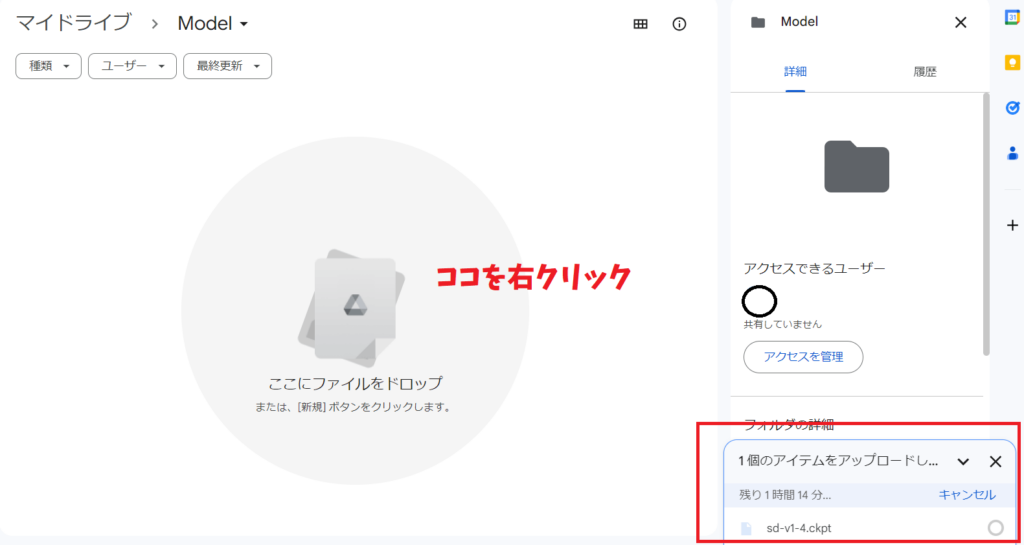

①“モデルのページ”の「Download the weights」にある『sd-v1-4.ckpt』をクリックしてダウンロード

②Googleドライブにログインする

③モデルをアップロードするフォルダを作成する

①“モデルのページ”の「Download the weights」にある『sd-v1-4.ckpt』をクリックしてダウンロード

※このモデルのファイルは4GBと大容量で、ダウンロード時間は3-5分程度で完了します。

※このモデルのファイルは、checkpointファイルで、重みなどの学習済みモデルを再現するために必要なデータが取り込まれています。

②Googleドライブにログインする

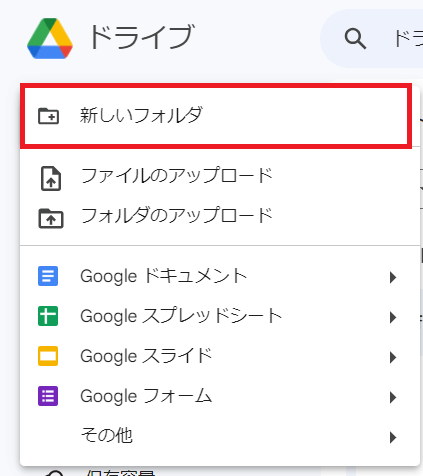

③モデルをアップロードするフォルダを作成する

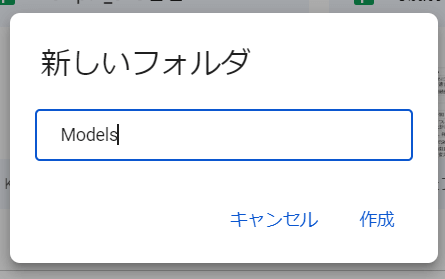

画像のように『+新規』→『新しいフォルダ』をクリックします。

ダイアログが表示されたら、“Models”などのフォルダ名を入力して『作成』をクリックします。

先程作成したフォルダを開き、ダウンロードした学習済みモデルのファイル(今回はsd-v1-4.ckpt)をドラッグして、アップロードします。

4GBあるので少し時間がかかります。

アップデートが完了したら、フォルダにモデルがきちんと入っているか確認してくださいね。

②URLからダウンロード

Stable Diffusionをインストールし、セッションが繋がっている状態から始めてください。

①新しくコードを追加して、以下のコードを実行します。

!curl -Lo /content/stable-diffusion-webui/models/Stable-diffusion/v1-5-pruned-emaonly.ckpt https://huggingface.co/LarryAIDraw/v1-5-pruned-emaonly/resolve/main/v1-5-pruned-emaonly.ckptURLから指定のディレクトリに、モデルをダウンロードするためのコードで、

黒色…ディレクトリのパスコード、赤色…ファイル名、緑色…モデルのURL

となっています。

例えば、yayoi_mixを追加する場合は、以下のように書き換えればOKです。

!curl -Lo /content/stable-diffusion-webui/models/Stable-diffusion/yayoiMix_v20.safetensors

https://civitai.com/models/83096/yayoimixこの方法は、Google Colab上で完結するので非常に便利ですが、モデルのデータ容量が大きいので、何らかの形で接続エラーが起きてしまうこともあります。

その場合は、方法①で紹介した1度ローカルに保存してからGoogleドライブに保存するやり方でやってみてください!

※Stable Diffusionのモデルの概要や導入方法・使い方など、以下の記事で詳しく解説しています!

Google Colab版Stable Diffusionに拡張機能を導入する方法

Stable Diffusionには便利な拡張機能ツールが無数に存在しています。

基本的に、どの拡張機能も同じインストール方法なので、以下の手順を参考にして導入してみてください!

- Stable Diffusionの“Extentions”タブを開く

- “Available”タブを開き、“Load from:”ボタンをクリック(※“tab”と“UI related”にチェックが入っていないことを確認)

- リストの中から拡張機能を探し、“Install”をクリック

- “Settings”タブに移動し、“Reload UI”をクリック

※Stable Diffusionの拡張機能のインストール方法については、以下の記事で詳しく解説しています!

Google Colab版Stable DiffusionでLoRAを利用する方法

『LoRA』はベースモデルに対して、さらに学習済みモデルを適用できるという機能です。

LoRAを使う手順は、以下のようになります。

①Google Colabで『ノートブックを新規作成』し、“GPU”を設定する

②以下のコードを実行して、Stable Diffusionをインストールする

!git clone https://github.com/AUTOMATIC1111/stable-diffusion-webui

%cd /content/stable-diffusion-webui

!mkdir /content/stable-diffusion-webui/models/Lora③モデルをダウンロードし、以下のコードを実行する。(例)

!wget https://civitai.com/api/download/models/112499 -O /content/stable-diffusion-webui/models/Stable-diffusion/yayoiMix_v20.safetensors

④以下のコードを実行し、Loraをダウンロードする。(例)

!wget https://civitai.com/api/download/models/6244 -O /content/stable-diffusion-webui/models/Lora/Makima.safetensors⑤Stable Diffusionを以下のコードから立ち上げる

!python launch.py --share --xformers --enable-insecure-extension-access⑥呪文(プロンプト)を入力して画像を生成する。

例として、チェンソーマンのマキマというキャラクターのLoRAを使って画像を生成してみました。

プロンプト

((photorealistic:1.4)),best quality ,masterpiece, illustration, an extremely delicate and beautiful, extremely detailed ,CG ,unity ,8k wallpaper, Amazing, finely detail, masterpiece,best quality,official art,extremely detailed CG unity 8k wallpaper,absurdres, incredibly absurdres, huge filesize, ultra-detailed, highres, extremely detailed,beautiful detailed girl, extremely detailed eyes and face, beautiful detailed eyes,light on face,cinematic lighting, 1girl, looking at viewer, red hair, yellow eyes, white shirts, black necktie, <lora:Makima:1.3>ネガティブプロンプト

lowres, bad anatomy, text, bad face, error, extra digit, fewer digits, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, {blurry}, missing arms, missing legs, more than two legs, こちらが生成された画像になります!

こんな感じでLoRAのデータ通りの生成ができました!

※Stable DiffusionでLoRAを利用する方法については、以下の記事で詳しく解説しています!

Google Colab版Stable DiffusionでVAEを利用する方法

VAEとは”Stable Diffusionでイラスト生成する時に補助してくれるツール”です。VAEの種類によって彩度や色味、シャープ感などに違いがでます。

上記画像をご覧ください。VAEなしで生成した画像は全体にモヤがかかっているのに対して、VAEありで生成した画像は全体がハッキリしているのが分かると思います。

このようにVAEを導入することで高画質化することができます。簡単に導入して利用することができますので、以下の記事を参考にしてください!

Google Colabでファインチューニングはできるのか?

結論から言うと、Google Colabでファインチューニングはできます!

ファインチューニングとは、『機械学習において、あるデータセットを使って事前学習したモデルの一部や全体を、別のデータセットを使って再実行することで、新しいタスク向けに機械学習モデルのパラメータを微調整すること』です。

その方法について解説していきます!

①まずは、Stable Diffusionの環境構築を行ってください。

当記事のこちらを参考にしてください。

②次に、以下のコードを実行してファインチューニング用のライブラリを設定します。

%cd /content/

!git clone https://github.com/rinongal/textual_inversion.git

%cd /content/textual_inversion

!pip install -e .③以下のコードを実行して、その他必要なライブラリをインストールします。

!pip install pyyaml tqdm easydict scikit-image scikit-learn tensorflow matplotlib joblib albumentations pandas hydra-core pytorch-lightning tabulate kornia tabulate packaging scikit-learn wldhx.yadisk-direct --quiet

!pip uninstall opencv-python-headless -y --quiet

!pip install opencv-python-headless==4.1.2.30 --quiet

!pip install --upgrade --force-reinstall git+https://github.com/arogozhnikov/einops.git④次に、ファインチューニング用のデータセットを準備します。

ご自身のお好きな枚数やサイズの画像をGoogleドライブの”My Drive”に用意し、以下のコードを実行してください。

!cp /content/drive/MyDrive/data/sd_dataset.zip /content

!unzip -o /content/sd_dataset.zip ⑤以下のコードを実行して学習させます。

!python main.py --base configs/stable-diffusion/v1-finetune.yaml

-t \

--actual_resume /content/stable-diffusion/models/ldm/stable-diffusion-v1/model.ckpt \

-n v1 \

--gpus 0, \

--data_root /content/textual_inversion/sd_dataset※バックスラッシュが“¥”に文字化けしているので、コードを実行する際はバックスラッシュに変更してください。

『actual_resume』は、環境構築でダウンロードしたモデルの重みで、『data_root』は、準備したデータセットディレクトリを指定してください。

万が一以下のようなエラーが出た場合は、フォントを変更してください。

File "/content/textual_inversion/ldm/util.py", line 25, in log_txt_as_img

font = ImageFont.truetype('data/DejaVuSans.ttf', size=size)Google Colabでは、以下のフォントが実行可能です。

!ls /usr/share/fonts/truetype/humor-sans/Humor-Sans.ttf⑥最後に、以下のキーワード部分をお好きな呪文(プロンプト)に変更し実行します。

initializer_words: ["beautiful", "woman", "cafe"]以上の方法で、Google Colabでファインチューニングができますので、是非参考にしてください!

Stable Diffusionで画像生成する際におすすめの呪文(プロンプト)

Stable Diffusionに指示するテキスト・単語は『呪文(プロンプト)』と呼ばれています。Stable Diffusionにイメージに合った画像を生成してもらうためには、的確な呪文(プロンプト)を入力する必要があります。

このサイトでは、さまざまな呪文(プロンプト)を一覧にまとめた記事が沢山あるので、今から紹介する記事も併せて参考にしてみてください!

●全1500種類以上の呪文(プロンプト)大全!

●呪文(プロンプト)を入力するコツ

●呪文(プロンプト)を保存する方法

Stable Diffusionで画像生成をする時におすすめのストレージ容量

Stable Diffusionで画像生成をする際には、イメージ通りの画像が生成できるまで何度も何度も繰り返し生成していきます。

さらに、モデルをダウンロードする際には数ギガもの容量が必要となるため、大容量のストレージであるHDDやSSDを外付けすることをオススメします!

容量を重視するならHDD、読み込みや書き込みのスピード感や静音性を重視するならSSDを選びましょう。

まとめ

いかがでしたでしょうか?

Google ColabでStable Diffusion Web UIを立ち上げる方法や使い方について、分かりやすく徹底的に解説してきました!

今回のポイントをまとめると、以下のようになります。

- Stable Diffusionは基本的に商用利用ができる

- Google Colaboratoryの注意点

- Google Colabを無料で利用するのは厳しい

- 有料プラン『Google Colab Pro』が不可欠

- 100コンピューティングユニットの制限がある

- Googleドライブや仮想マシンによって使い心地が異なる

- Google Colabを使ってStable Diffusion Web UIを立ち上げる方法

- 1度Googleドライブにノートブックを保存して永続的に使えるようにして立ち上げる方法→ガッツリ使いたい人向け

- そのままGoogle Colaboratoryで立ち上げる方法→趣味程度で楽しみたい人向け

- Google ColabでのStable Diffusionの使い方

- 指示したい英単語を呪文(プロンプト)欄に、生成してほしくない要素を英単語でネガティブプロンプト欄に入力

- 『Generate』ボタンを押す

- Google Colab版Stable Diffusionでモデルを追加する方法

- 『Hugging Face』からダウンロード

- URLからダウンロード

- Google Colab版Stable Diffusionで拡張機能をインストールする方法

- “Extentions”タブ→“Available”タブを開き、“Load from:”ボタンをクリック

- リストの中から『Image browser』を探し、“Install”をクリック

- “Settings”タブに移動し、“Reload UI”をクリック

- Google Colab版Stable Diffusionでは、LoRAやVAEも導入できる

- Google Colabではファインチューニング可能!

- Stable Diffusionで画像生成をする時におすすめのストレージ容量はHDD、SSD

ローカル環境でStable Diffusionを利用すると、重くて動きづらかったりエラーが頻繁に起きてしまったりします。

でも、Google Colabを使ってStable Diffusionを利用すれば、効率的でスムーズな画像生成が可能になりますので、今回の記事を参考にしてStable Diffusionを使ってみてください!

実際に稼いでいる人の画像生成AIのスキルと収益化方法を知っていますか?

romptn ai が開催する完全無料のAIクリエイターセミナーでは、現場で活躍するプロから下記のような内容を学べます。

- ゼロから画像生成AIで収益化を達成するための具体的なロードマップ

- 実績のある講師が実践する初心者を脱出するための必須スキルと最新ツール

- Nano Banana や Grokなどスマホからでもできる本格的な画像生成AI活用方法

- 広告画像や映像など実際の制作過程をイメージするための講師によるライブデモ

2時間のオンラインセミナーで、ただ画像生成AIや動画生成AIの上級スキルや最新ツールを知るだけでなく、実際に収益化を達成する一歩を踏み出すための必須知識を学ぶことができます。

- 大手企業6社と契約実績(TOYOTA, mercari, 伊藤園 等)

- AI映画制作3本、WORLD AI FILM FESTIVAL 2026 in KYOTO にて2冠達成

- Best AI Anime 受賞

- Japan Best AI Film(グランプリ)受賞(応募431作品中)

- 経歴:元WEBデザイナー・マーケター → 2023年に生成AIと出会い転身 → プロのAIクリエイターへ