AIや画像生成技術に興味がある方なら、一度は「もっと簡単に、もっと自由に画像を生成したい」と思ったことがあるのではないでしょうか?

しかし、実際には多くの制約や限界に直面し、理想の画像を生成するのはなかなか難しいものです。

そのお悩み、拡張機能『CLIP Changer』で解消しませんか??

この記事では、「CLIP Changer」が「Stable Diffusion WebUI」の拡張機能としてどのような機能を持ち、どのようにそれを活用できるのかを詳しく解説します。

具体的には、「CLIPの変更方法」、設定のカスタマイズ方法など、使い方のポイントや注意点も含めてご紹介します。

興味を持った方は、ぜひ最後までお読みいただき、画像生成の新しい可能性を一緒に探ってみましょう!

内容をまとめると…

CLIP ChangerはStable Diffusion WebUIのCLIPモデルをより強力なものに差し替えられる拡張機能

CLIPはOpenAI開発の「言葉と画像を関連付ける技術」で、変更することでプロンプトの解釈精度や画像生成の質が変わる

Settingsから使用するCLIPTextModelとCLIPTokenizerを指定するだけで切り替え可能で、チェックを外せば元に戻せる

画像生成プロセスに直接影響するため、本番環境の前にGoogle ColabやテストPC環境での事前検証が推奨される

きれいな画像を作れるようになっただけで、収益化できずに止まってませんか?

romptn ai では、実際に画像生成AIで稼いでいるプロを講師に招いた完全無料のAIクリエイターセミナーを開催しています。

2時間のオンラインセミナーで、実際に稼いでいる人が使う最新画像生成AIツールや上級者にステップアップするための必須スキルなどの知識面はもちろんのこと、ゼロから収益化を実現するための具体的なロードマップを体験談ベースで詳しく学ぶことができます。

また、豪華な無料参加特典も用意していますので、ぜひご興味を持った方はお気軽に下記のボタンから詳細をチェックしてみてください!

\ 現役の画像生成AIのプロから学べる! /

無料セミナーの詳細をみるそもそも「CLIP」とは?

「CLIP」はOpenAIによって開発された技術で、言葉と画像を関連付けることが得意です。

「CLIP」とは、「Constastive Language-Image Pretraining」の略で、画像とテキストの説明を受け取ると、その画像に最も関連するテキストの説明を予測することができます。

「CLIP」はオープンソースとして公開されており、自然言語処理とコンピュータビジョンの両方の技術を組み合わせて学習します。

また、特定のラベルで訓練されていなくても、それを認識する「ゼロショット学習」という能力も持っています。

「CLIP」の主な特徴

- 画像分類: 伝統的な画像分類タスクにおいて、特定のカテゴリの画像を認識するために使用されます。例えば、動物の種類や物体のカテゴリなどを識別するのに役立ちます。

- ゼロショット学習: CLIPは、訓練データに存在しない新しいカテゴリの画像も認識する能力があります。これにより、新しいカテゴリのデータを収集してモデルを再訓練することなく、未知のカテゴリの画像を分類することが可能になります。

- テキストと画像の関連付け: CLIPは、テキストの説明と画像の内容を関連付けることが得意です。これにより、特定のテキストの説明に最も適している画像を検索したり、逆に画像に基づいて最も関連性の高いテキストを生成することができます。

「CLIP」の種類

Stable Diffusionで利用可能な「CLIP」の主な種類としては以下のものがあります。

- openai/clip-vit-large-patch14: これはCLIPの基本的なモデルで、多くのタスクに適用可能です。

- openai/clip-vit-large-patch14-336: これはより高度なタスクに適用されるモデルです。

拡張機能「CLIP Changer」とは?

「CLIP Changer」は「Stable Diffusion WebUI」の拡張機能で、元々WebUIに備わっている「CLIP」をより強力なものに変更することができます。

この拡張機能を使用することで、以下のことが可能となります。

- CLIPの変更: デフォルトのCLIPを他の種類のCLIPに変更し、異なるCLIPの性能や特性を活用して画像生成の結果を変えることができます。

- 効果の強化: より強力なCLIPに変更することで、入力した呪文(プロンプト)に基づく画像生成の効果や質を向上させることが期待されます。

- 設定のカスタマイズ: 設定画面を通じて、使用するCLIPの種類を簡単に選択・変更することができます。

CLIPの種類を変更する際には、対応するCLIPTextModelとCLIPTokenizerを指定する必要があります。

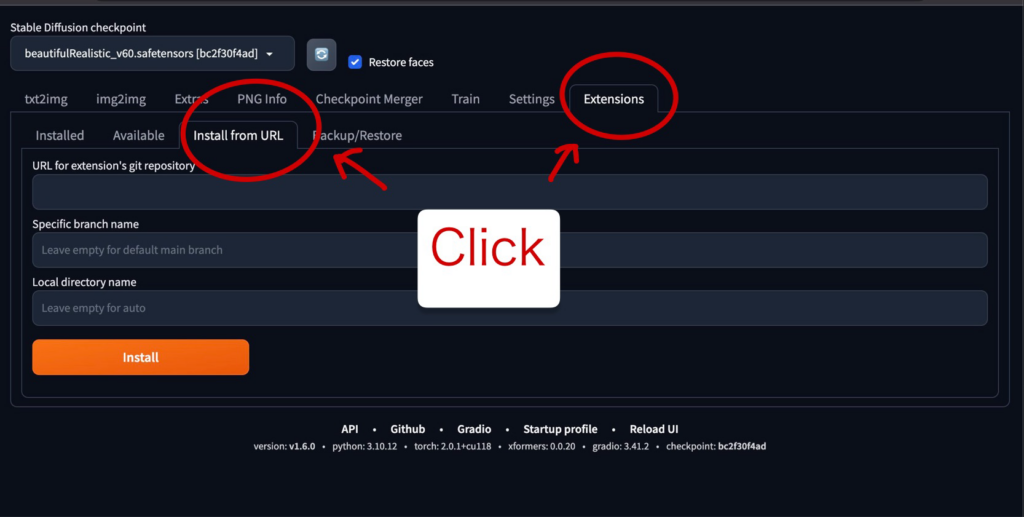

拡張機能「CLIP Changer」の導入方法

それでは実際の画面を見ながら導入の手順を確認しましょう。

導入手順

1、「Stable diffusion」を起動します。

2、「Extensions」タブに移動し、「Install from URL」タブを選択します。

3、以下の「URL」を「URL for extension’s git repository」に貼り付けます。

https://github.com/bbc-mc/sdweb-clip-changer4、「Install」ボタンをクリックします。インストールが完了すると、文字が表示されます。

5、「Extensions」タブに移動し、「Installed」タブを選択します。次に、「Apply and quit」ボタンをクリックして再起動します。

以上の手順で「CLIP Changer」をStable Diffusion Web UIに導入することができます。

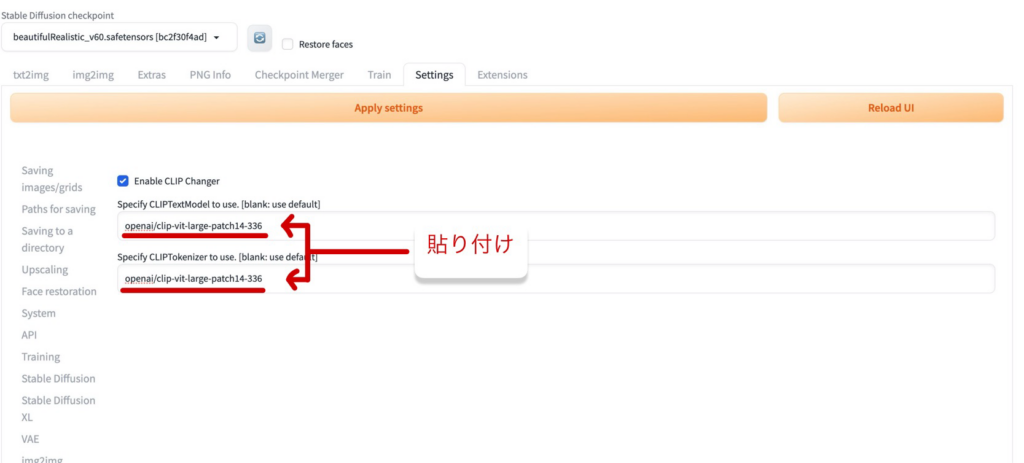

拡張機能「CLIP Changer」の使い方

「CLIP Changer」の使いからは非常にシンプルです。「CLIP Changer」の使い方は以下の通りです。

使い方

1、Stable Diffusion 「Setting」タブを開く。

2、「Setting」の項目に「CLIP Changer」があるので見つかるまで下にスクロールし、「CLIP Changer」をクリックする。

3、「CLIP Changer」を選択すると以下の項目が表示されます。

- Enable CLIP Changer: このオプションをチェックすることで、「CLIP Changer」拡張機能を有効にします。

- Specify CLIPTextModel to use: 使用するCLIPモデルを指定します。

- Specify CLIPTokenizer to use: 使用するCLIPのトークナイザを指定します。

「Specify CLIPTextModel to use」と「Specify CLIPTokenizer to use」の入力欄に使用したいCLIPモデルを入力します。

今回は動作が確認されている「openai/clip-vit-large-patch14-336」を使用します。

「Enable CLIP Changer」にチェックも忘れずに行いましょう。

4、最後に「Apply settings」と「Reload UI」をクリックして終了です。

以上で「CLIP Changer」の設定は完了です。

エラーが発生した場合の対処法

「CLIP Changer」を使用する際、エラーが発生することがあります。そんな時のための対処法を以下にまとめました。

1. 再起動

まず、Stable Diffusion Web UIを再起動してみてください。多くの場合、一時的なエラーやバグは再起動することで解消されます。

2. 設定の確認

「CLIP Changer」の設定を再度確認し、正しいCLIPモデルやトークナイザが選択されているかを確認してください。

3. 拡張機能の再インストール

「CLIP Changer」拡張機能が正常に動作しない場合、一度アンインストールし、再度インストールしてみてください。

4. コミュニティやフォーラムの利用

「CLIP Changer」やStable Diffusion Web UIに関連するコミュニティやフォーラムを利用し、他のユーザーからのアドバイスや解決策を求めることができます。

まとめ

いかがでしたでしょうか?

Stable Diffusionの拡張機能の1つである「CLIP Changer」について解説してきました。

今回のポイントをまとめると、以下のようになります。

- 「CLIP Changer」を使用ことで、入力した呪文(プロンプト)に基づく画像生成の効果や質を向上させるさせることができる

- 「CLIP」の変更は一度導入が済めば、ボタン1つで設定の変更が可能

- 動作にエラーが生じることがあるため、かならず試運転が必要。

画像生成技術は日々進化しており、その中でも「CLIP Changer」は、私たちのクリエイティブな活動をさらに豊かにするための強力なツールとして注目されています。

この記事を通じて、その魅力や活用方法を知っていただけたら嬉しいです。

そして、あなたの画像生成の冒険が、より自由で、より楽しいものになることを心から願っています。

実際に稼いでいる人の画像生成AIのスキルと収益化方法を知っていますか?

romptn ai が開催する完全無料のAIクリエイターセミナーでは、現場で活躍するプロから下記のような内容を学べます。

- ゼロから画像生成AIで収益化を達成するための具体的なロードマップ

- 実績のある講師が実践する初心者を脱出するための必須スキルと最新ツール

- Nano Banana や Grokなどスマホからでもできる本格的な画像生成AI活用方法

- 広告画像や映像など実際の制作過程をイメージするための講師によるライブデモ

2時間のオンラインセミナーで、ただ画像生成AIや動画生成AIの上級スキルや最新ツールを知るだけでなく、実際に収益化を達成する一歩を踏み出すための必須知識を学ぶことができます。

- 大手企業6社と契約実績(TOYOTA, mercari, 伊藤園 等)

- AI映画制作3本、WORLD AI FILM FESTIVAL 2026 in KYOTO にて2冠達成

- Best AI Anime 受賞

- Japan Best AI Film(グランプリ)受賞(応募431作品中)

- 経歴:元WEBデザイナー・マーケター → 2023年に生成AIと出会い転身 → プロのAIクリエイターへ