NovelAI Diffusionは、アニメ・イラスト調の画像生成に強いAIサービスです。

プロンプト(呪文)とタグを組み合わせることで、キャラの雰囲気や背景、画作りまでかなり細かくコントロールできます。

特に2025年5月に登場したV4.5では、画質とプロンプトへの忠実度が大きく改善され、思い通りの仕上がりに寄せやすくなりました。

この記事では、NovelAI Diffusionの基本、V4.5の特徴、料金、使い方、つまずきやすいポイントまで、ひと通りまとめて解説していきます。

内容をまとめると…

NovelAI Diffusionはアニメ・イラスト調の生成に強い

V4.5は画質とプロンプト忠実度が改善された世代

よくある崩れ(手・顔)は、構図で回避+ネガティブ+最終インペイントが最短

きれいな画像を作れるようになっただけで、収益化できずに止まってませんか?

romptn ai では、実際に画像生成AIで稼いでいるプロを講師に招いた完全無料のAIクリエイターセミナーを開催しています。

2時間のオンラインセミナーで、実際に稼いでいる人が使う最新画像生成AIツールや上級者にステップアップするための必須スキルなどの知識面はもちろんのこと、ゼロから収益化を実現するための具体的なロードマップを体験談ベースで詳しく学ぶことができます。

また、豪華な無料参加特典も用意していますので、ぜひご興味を持った方はお気軽に下記のボタンから詳細をチェックしてみてください!

\ 現役の画像生成AIのプロから学べる! /

無料セミナーの詳細をみるNovelAI Diffusionとは?

NovelAI Diffusionは、テキスト(プロンプト)から画像を生成できるAI機能です。

なかでも、アニメ・イラスト調の表現に強く、キャラクターの顔立ちや塗りの雰囲気、絵柄のテイストを「それっぽく」まとめやすいのが特徴です。

写真風よりも、二次元寄りのビジュアルを作りたい人に向いています。

技術的には、Stable Diffusion(画像生成AIの代表的な仕組み)をベースにしつつ、NovelAI側で独自の調整や改良が加えられています。

そのため、同じようにプロンプトで生成するタイプでも、出力の傾向や得意な表現が異なります。

「アニメっぽさが出しやすい」「タグでコントロールしやすい」と感じる人が多いのは、この方向性の違いが大きいです。

またNovelAIは、もともと文章生成AIサービスとして始まった経緯があります。

そこに画像生成機能としてDiffusionが加わった形なので、創作に必要な“文章”と“ビジュアル”を同じサービスの中で行き来できるのも魅力です。

小説のイメージボードを作ったり、キャラクター像を固めたりと、発想から制作までの流れをつなげやすくなります。

- NovelAI Diffusionは、テキスト(プロンプト)から画像を生成できるAI機能

- 特にアニメ・イラスト調の画像生成に特化しており、二次元寄りの表現が得意

- Stable Diffusionをベースにしつつ、NovelAI独自の調整・改良が加えられた

- NovelAIは元々文章生成AIサービスとして始まり、後から画像生成(Diffusion)が追加された

NovelAI Diffusion V4.5の新機能!V4からの進化ポイントとは

V4.5はV4のアップデート版で、画質とプロンプトへの忠実度が強化された世代です。

結果として、同じプロンプトでも仕上がりが安定しやすく、細部の破綻も起きにくくなりました。

またV4.5は2025年5月にリリースされ、「Curated版」と「Full版」の2種類がある点も押さえておきたいポイントです。

V4からの主な改善点

V4.5で「使いやすくなった」と感じるポイントは、主に次のあたりです。

- プロンプトへの忠実度が向上

書いた内容が反映されやすくなり、「なんか違う」が減りやすいです。まずは主役→特徴→背景の順で素直に書くと、効果が分かりやすく出ます。 - 画像品質の向上(カスタムVAE導入)

線のまとまりや塗りの安定感が出やすく、顔や髪などの見栄えが整いやすくなります。アップスケール前の“素の画”が底上げされるイメージです。 - 複数キャラクターの描き分け機能の強化

2人以上の生成で起きがちな「髪色が混ざる」「特徴が入れ替わる」といった事故が減りやすくなります。ベース(共通部分)とキャラ別指定を分けるのがコツです。 - 数値での強調指定が可能に(例::2 や :-1 などの記法)

「ここは強め」「これは弱め」を明確に調整できます。やりすぎると不自然になりやすいので、最初は少しだけ強くするくらいが扱いやすいです。 - masterpieceタグの復活

いわゆる品質系タグの一つで、雰囲気を整える方向に働きやすいタグです。入れすぎると画が固くなることもあるので、まずは1〜2個で試すのがおすすめです。 - locationタグの追加

背景の指定が通りやすくなり、「屋内外」だけでは曖昧だったシーンを固定しやすくなります。背景が弱いときは、背景タグを増やすより、場所を具体化する方が効くことが多いです。

| V4 | V4.5 |

|---|---|

例:1girl, masterpiece, best quality, very aesthetic, blue eyes, long black hair, school uniform, smiling, outdoor, cherry blossoms, soft lighting, detailed faceNovelAI Diffusion V4.5「Curated」と「Full」の違いとは?

V4.5には「Curated」と「Full」の2種類があり、ざっくり言うと“表現の制限の強さ”が違います。

Curatedは、全年齢向けに調整されたモードです。

過激な表現になりにくく、SNS投稿やポートフォリオ用途など「安全側に寄せたい」場面で使いやすいのがメリットです。

Fullは、表現の制限が少なく、より幅広い出力に対応します。

作品づくりで“尖った雰囲気”や“強い表現”を求める場合に選ばれやすい一方、公開先の規約や取り扱いにはより注意が必要です。

- まず迷ったらCurated(公開や共有が前提なら特に安心)

- 創作の自由度を優先するならFull(ただし公開・商用はルール確認が必須)

NovelAI Diffusionの料金プラン!無料で使える?

2026年1月時点では無料トライアルがありますが、NovelAI Diffusionは基本的に有料サービスです。

| ヘッダーラベル | Tablet | Scroll | Opus |

|---|---|---|---|

| 月額料金 | $10/月 | $15/月 | $25/月 |

| 生成可能枚数(Anlas消費量) | 従量課金(生成ごとにAnlas消費)/ボーナスAnlas:1,000/Anlas購入20%割引 | 従量課金(生成ごとにAnlas消費)/ボーナスAnlas:1,000/Anlas購入20%割引 | 無制限/ボーナスAnlas:10,000/Anlas購入20%割引 |

| 利用可能な機能 | 画像生成へのアクセス/Anlas購入20%割引 | 画像生成へのアクセス/Anlas購入20%割引 | 画像生成へのアクセス(無制限)/Anlas購入20%割引 |

NovelAI Diffusionの始め方!アカウント登録から初期設定まで

NovelAI Diffusionはとても簡単に始められます。

右上のログインからアカウント登録をします。

プランについては、最初は無料枠や従量課金で試して、必要になったら月額プランに切り替える形でも問題ありません。

ログインができたら「画像を生成する」を選択すると、画像生成ができる画面に飛びます。

詳しい使い方は次の章で説明していきます。

NovelAI Diffusionの基本的な使い方

- モデル選択(NAI Diffusion V4.5 Full):使う生成モデルを切り替える場所。基本はV4.5 FullでOK

- ベースプロンプト:生成したい内容を入れるメイン欄(キャラ・服装・背景・画風など)

- 除外したい要素:出てほしくない要素を書く欄(文字、崩れ、余計な物など)

- ランダム化:プロンプトのたたき台を自動生成。出た文を編集して使うのが基本。(×:入力内容をクリア↻:ランダム案を出し直し(再抽選))

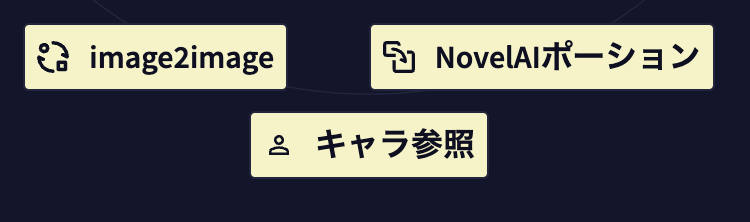

- 参照用画像を追加(任意):画像をアップして雰囲気・構図・色味などを寄せるための枠(↑(アップロード):参照画像を追加 ✎(ペン):参照画像に指示を書き込み(対応時))

- ステップ:描き込み回数。上げるほど作り込みやすいが時間も増える(目安20〜30)

- 正確度:プロンプトにどれだけ忠実にするか。上げすぎると不自然になることも

- シード値:同じ条件で似た絵を再現するための番号。N/Aは固定なし

- サンプラー(例:Euler Ancestral):生成の計算方式。絵の出方や安定感が変わる

NovelAI Diffusionは、ざっくり言うと「モデルを選んで、プロンプトを書いて、必要なら設定を調整して生成する」だけです。

最初は細かい数値を触らなくても、テンプレ+少しの調整で十分きれいに出せます。

- モデル(V4.5など)を選ぶ

- プロンプト(描きたい内容)を入力

- ネガティブプロンプト(避けたい要素)を入力

- サイズや枚数など最低限のパラメータを設定(迷ったらデフォルトでOK)

- Generate(生成)を押す

- 良い結果だけ保存、微妙ならプロンプトを少し直して再生成

そのまま使えるプロンプト例は以下の通りです。

1girl, masterpiece, best quality, blue dress, blonde hair, green eyes, sitting on bench, park, afternoon, soft sunlight, peaceful atmosphere

ネガティブプロンプト例:

lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurryプロンプト(呪文)の書き方のコツ

NovelAI Diffusionのプロンプトは、基本的に英語タグをカンマ(,)で区切って並べるだけです。

迷ったら「主役 → 見た目 → 状況(背景)→ 雰囲気(光・質感)」の順で書くと、狙いがブレにくくなります。

- 英語で入力する(タグ形式が安定しやすい)

- カンマ「,」で要素を区切る

- 重要な要素ほど前に置く(主役・髪色・服・構図など)

- 先頭にクオリティ系タグを置く

例:masterpiece, best quality, very aesthetic - 見た目は具体的にする

例:髪色/目の色/服装/表情/ポーズ - 不要な要素は「除外したい要素(ネガティブ)」側に回す

例:text, watermark など

- {タグ}:強調(効かせたい要素を前に出す)例:{blue eyes}

- {{タグ}}:さらに強調(強めすぎ注意)例:{{blue eyes}}

- 数値で指定(推奨):1.3::タグ:: みたいに書くと、強さを数字で調整できる例:1.5::blue eyes::(かなり強め)例:0.7::hat::(弱める)

- -1::タグ:::その要素を「出にくくする/避ける」例:-1::hat::(効きが弱いときは -2, -3 と段階的に強める)

プロンプト例:

masterpiece, best quality, very aesthetic, 1girl, red hair, twin tails, yellow eyes, school uniform, white shirt, blue skirt, smiling, peace sign, classroom, detailed face, detailed eyes, soft lightingネガティブプロンプトとは?

ネガティブプロンプトは、「出したくない要素」をAIに伝えるための指定です。

通常のプロンプトが「こう描いてほしい(足したい)」だとしたら、ネガティブは「これは避けてほしい(引きたい)」という役割になります。

とくにNovelAI Diffusionでは、ネガティブを入れるだけで手や指の破綻・文字や透かし・低画質っぽさなどの“ありがちな事故”が減りやすく、最初に設定しておくと安定します。

- 品質関連:lowres, worst quality, bad quality

- 解剖学的なミス(崩れ対策):bad anatomy, bad hands, missing fingers

- 不要な要素(文字・透かし等):text, watermark, signature

以下のテンプレをベースにして、「いらないものだけ残す」 方向に調整すると、作品の雰囲気を保ったまま失敗を減らせます。

lowres, bad anatomy, bad hands, text, error, missing fingers, extra digit, fewer digits, cropped, worst quality, low quality, normal quality, jpeg artifacts, signature, watermark, username, blurry, artist name以下の記事も合わせて参考にしていください!

NovelAI Diffusion V4.5の便利機能を使いこなそう!

V4.5は「複数キャラを混ぜずに描く」・「背景を狙って出す」・「好きな絵柄の雰囲気を移す」・「崩れた部分だけ直す」がやりやすいのが強みです。

ここでは4つの“便利機能”を、使いどころ→手順の順でまとめます。

キャラクタープロンプト機能で複数キャラを正確に描き分ける方法

複数キャラ生成で一番起きがちなのが「髪色や服が入れ替わる」「左右が逆になる」「距離感が崩れる」問題です。

キャラクタープロンプト(マルチキャラクタープロンプト)を使うと、キャラごとに特徴を分けて指定できるので、混ざりにくく安定します。

使い方は、ベース(共通)に「2girls」など人数・雰囲気・背景をざっくり入れ「キャラクターを追加」から人数分の枠を作り、それぞれにプロンプトを書いていくだけです。

最大6人まで対応しているので、2人組から集合絵まで幅広く使えます。

複数キャラの絵で関係性を作りたいときは、アクションタグを使うと指示が通りやすくなります。

- source#:行動する側(例:手をつなぐ側)

- target#:反応する側(例:照れる側)

- mutual#:お互い同じ状態にしたい(例:両方が手をつなぐ)

最初は1シーン1〜2個に絞ると崩れにくいです。

ベースプロンプト: 2girls, masterpiece, best quality, outdoor, park, holding hands

キャラ1: girl, long blue hair, blue eyes, white dress, smiling

キャラ2: girl, short red hair, green eyes, black shirt, jeans, laughinglocationタグで背景を指定する方法

「背景もちゃんと描いてほしいのに、人物だけが強く出てしまう」「屋内・屋外の指定がうまく効かない」そんなときに便利なのが locationタグ です。

このタグは、「場所(ロケーション)のある絵にして」とモデルへ伝えるためのもので、屋内・屋外を問わず、“背景のあるシーン”を作りやすくしてくれます。

従来は屋内ならindoors、屋外ならoutdoorsのように、まず環境を決め打ちして背景を誘導するのが基本でした。

V4.5ではlocationが追加されたことで、「屋内外はまだ決めないけれど、ちゃんと“場所のある背景”を出したい」という場面でも、よりスムーズに背景を組み立てられるようになっています。

location単体で終わらせず 「どんな場所か」を追加で言葉にすることです。

- まず location を入れて「背景がある構図」を促す

- 続けて 場所の種類(例:beach, street, classroom)

- さらに 時間・天候・雰囲気(例:sunset, night, rainy, soft lighting)

- 必要なら 背景の情報量(例:detailed background)も足す

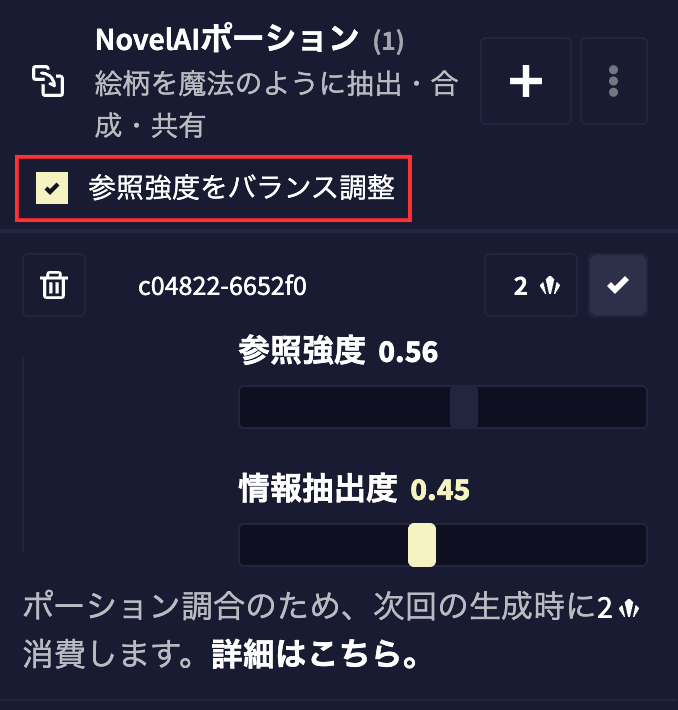

1girl, masterpiece, best quality, location, beach, sunset, white dress, wind, detailed backgroundポーション機能(Vibe Transfer)でスタイルを転送する方法

「この絵の雰囲気(色・質感・筆致)を、別の構図でも出したい」ならVibe Transfer(通称ポーション)が便利です。

参照画像を入れて、“雰囲気だけ”を抽出して寄せる使い方ができます。

- ステップ1参照画像をアップロード

- ステップ2Novel AI ポーションを選択

- ステップ3ポーションの強度を調整

- ステップ4プロンプトと組み合わせて生成

インペイント機能で部分的に修正する方法

「手だけ変」「顔が崩れた」「背景の看板文字を消したい」みたいに、一部だけ直したいときはインペイントが最短です。

修正したい範囲を塗って、そこにだけプロンプトを当て直せます。

なお、この機能はV4.5版では開発中のため、現時点ではV4を使用する必要があります。

実際に試すときは、生成画面のモデル表示(V4/V4.5)を必ず確認してください。

- 修正したい画像を開く

- Inpaintを選ぶ

- 直したい部分をブラシでマスク(塗る)する

- プロンプトで修正内容を指定する

【コピペOK】NovelAI Diffusionでよく使うタグ一覧

クオリティタグ

| 日本語 | プロンプト(タグ) |

|---|---|

| 高品質(定番) | masterpiece, best quality |

| 高解像度 | highres |

| 細部まで描き込み | ultra detailed, detailed |

| きれいな線 | clean lineart |

| 破綻しにくい | good anatomy |

キャラクターの容姿(髪型、目の色、服装等)

| 日本語 | プロンプト(タグ) |

|---|---|

| 女の子1人 | 1girl |

| 男の子1人 | 1boy |

| ロングヘア | long hair |

| ショートヘア | short hair |

| ツインテール | twin tails |

| 金髪 | blonde hair |

| 黒髪 | black hair |

| 青い目 | blue eyes |

| 緑の目 | green eyes |

| 制服 | school uniform |

| ワンピース | dress |

| パーカー | hoodie |

表情

| 日本語 | プロンプト(タグ) |

|---|---|

| 笑顔 | smile |

| 口を開けて笑う | open mouth |

| 怒り顔 | angry |

| 悲しい顔 | sad |

| 驚いた顔 | surprised |

| 照れ | blushing |

| きょとん | expressionless |

ポーズ

| 日本語 | プロンプト(タグ) |

|---|---|

| 立っている | standing |

| 座っている | sitting |

| 寝転ぶ | lying |

| 走る | running |

| ジャンプ | jumping |

| ピース | peace sign |

| 手を振る | waving |

| こちらを見る | looking at viewer |

構図

| 日本語 | プロンプト(タグ) |

|---|---|

| 顔アップ | close-up |

| バストアップ | upper body |

| 全身 | full body |

| ポートレート | portrait |

| 引き(広め) | wide shot |

| 上から(俯瞰) | from above |

| 下から(煽り) | from below |

| 背景ぼかし | depth of field |

背景

| 日本語 | プロンプト(タグ) |

|---|---|

| 教室 | classroom |

| 公園 | park |

| 海辺 | beach |

| 街中 | city street |

| カフェ | cafe |

| 夜景 | night, city lights |

| 夕焼け | sunset |

| 桜 | cherry blossoms |

ライティング(光)

| 日本語 | プロンプト(タグ) |

|---|---|

| 柔らかい光 | soft lighting |

| 逆光 | backlighting |

| リムライト | rim lighting |

| 木漏れ日 | dappled sunlight |

| ドラマチック | dramatic lighting |

| シネマ調 | cinematic lighting |

| 光が差し込む | god rays |

年代タグ

| 日本語 | プロンプト(タグ) |

|---|---|

| 2000年代っぽい | year 2000 |

| 2010年代っぽい | year 2010 |

| 2020年代っぽい | year 2020 |

| 2025年っぽい | year 2025 |

| レトロ | retro |

| 90年代アニメ風 | 90s anime |

smiling: 笑顔

angry: 怒り顔

sad: 悲しい顔

surprised: 驚いた顔

blushing: 照れている【実践例】NovelAI Diffusionのプロンプトと生成画像を紹介

ここからは、実際に使えるプロンプト例を4パターン紹介します。

最初はシンプルな構成で安定して出す → 少しずつ要素を足すのがコツです。

髪色・服装・背景などは単語を差し替えるだけで印象が大きく変わるので、まずは“テンプレ”として保存しておくと制作が速くなります。

シンプルなイラストのプロンプト例

まずは要素を絞った、扱いやすい基本形です。

キャラの外見(髪・目・服)を決めて、背景は白などにすると崩れにくく、雰囲気の調整もしやすいです。

masterpiece, best quality, very aesthetic, 1girl, purple hair, long hair, yellow eyes, witch hat, black dress, holding staff, magical effect, detailed face, white background複数キャラを生成するプロンプト例

2人以上を同時に描きたいときは、ベース(共通の状況)→ キャラごとの特徴の順に分けて書くと安定します。

「同じ場所にいる」「会話している」などの共通シーンを先に固めると、キャラの役割も伝わりやすくなります。

ベース: 2girls, masterpiece, best quality, cafe, sitting, talking, coffee cups on table

キャラ1: girl, brown hair, short hair, blue eyes, casual clothes, smiling

キャラ2: girl, blonde hair, long hair, green eyes, cardigan, laughing背景込みのイラストのプロンプト例

背景をしっかり描きたい場合は、キャラ指定に加えて場所・時間帯・光を入れると完成度が上がります。

「ruins」「dramatic lighting」など、背景側の単語を少し増やすだけで“絵としての情報量”が増えます。

masterpiece, best quality, very aesthetic, 1girl, white hair, blue eyes, fantasy armor, sword, standing, ancient ruins, dramatic lighting, detailed background, epic sceneアクション系イラストのプロンプト例

動きのある絵は、ポーズ・動作・エフェクトをセットで入れると伝わりやすいです。

「jumping」「dynamic pose」「energy effects」のように、“動き”の単語を明示すると、静止画になりにくくなります。

masterpiece, best quality, very aesthetic, 1girl, pink hair, twin tails, magical girl outfit, jumping, casting spell, magic circle, energy effects, dynamic pose, city background at nightNovelAI Diffusionを使う際の注意点とよくある質問

ここからは、NovelAI Diffusionを実際に使ううえでの注意点と「よくある疑問」をまとめて確認していきます。

生成がうまくいかないときの対処や、Anlas不足などのありがちな悩みもあわせて整理するので、困ったときのチェックリストとして使ってください。

利用規約と商用利用について

NovelAI Diffusionで作った画像は、基本的にユーザー側に権利(所有)が残る形になっています。

つまり「作った作品を自分の活動に使う」こと自体はしやすい設計です。

一方で、NovelAIがあなたの作品を公開・販売してくれるわけではなく、公開や商用利用の責任(権利処理やトラブル対応)は作り手側にあります。

商用利用するなら、最低限ここだけは押さえておくと安全です。

- 第三者の権利(著作権・商標・肖像権など)を侵害しないようにする

- 万一に備えて、制作データや生成物は定期的にバックアップしておく(解約後は一定期間で削除される可能性があるため)

- 迷うケースは、販売前に利用規約・法律の範囲で確認する(国や用途で扱いが変わります)

版権キャラクターの再現について

版権キャラ(既存作品のキャラクター)っぽい画像は作れてしまうことがありますが、「作れる」=「商用で使ってOK」ではありません。

特に販売・広告・グッズ化などの商用利用は、権利者の許可が必要になるケースが多く、リスクが上がります。

安全に寄せるなら、次の考え方が現実的です。

- “そのキャラそのもの”に見える再現は避ける(髪型・衣装・固有小物・色配置・ロゴなどが一致すると危険度が上がる)

- 作品名・キャラ名・ロゴなど、商標になりやすい要素は使わない

- 商用目的なら、完全オリジナルのキャラ設計に寄せる(雰囲気だけ参考にして要素を組み替える)

- どうしても使うなら、許諾を取る/二次創作OKのガイドラインがある範囲に限定する

【FAQ】よくあるトラブルと対処法

- Q画像が思い通りに生成されない

- A

プロンプトを“要素の優先順位”で整理して、強調・ネガティブ・設定(解像度/Steps/CFG)を整えると安定します。

- 順番を整える:人物 → 構図 → 背景 → 光 の順に並べる(盛りすぎない)

- Seed固定:比較しながら1点ずつ直す(闇雲に回さない)

- CFG/Stepsは動かしすぎない:まずは標準寄りで、崩れるなら少し下げ/上げで調整

- ネガティブは最低限:text / watermark / bad anatomy 系を入れてノイズを減らす

- Q指や手がおかしくなる

- A

手は“苦手部位”なので、ネガティブ強化+構図を簡単にして、最後はインペイントで直すのが最短です。

- まず構図で回避:手がアップ・中心に来る構図は難易度が跳ね上がる

- ネガティブを追加:bad hands / extra fingers / missing fingers など

- 手の状態を指定:holding ○○ / hands behind back / peace sign などで迷いを減らす

- 仕上げはインペイント:崩れた手だけ塗って描き直すのが一番早い

- Q顔が崩れる

- A

顔は“解像度とディテールの出し方”で差が出るので、顔向けタグ+高解像度化(またはインペイント)で整います。

- バストアップ寄りにする:全身より顔が安定しやすい

- 顔向けの指定を足す:detailed face / detailed eyes / looking at viewer など

- CFG/Stepsを微調整:上げすぎは破綻しやすいので少しずつ

- 最後はインペイント:目・口・輪郭だけ直すと成功率が高い

- QAnlasが足りない

- A

まず“消費を減らす設定”に寄せて、足りない分は都度購入か上位プランで補うのが現実的です。

- 消費を減らす:解像度・同時生成枚数を上げすぎない

- 試行回数を減らす:Seed固定で比較、変更点を1つに絞る

- 足りない分は都度購入:必要な時だけAnlas追加

- 頻繁に使うならプラン見直し:継続利用なら月額の方が安いことも

まとめ

NovelAI Diffusionは、アニメ・イラスト調に強い画像生成サービスで、V4.5で画質と指示の通りやすさが向上しました。

使い方は「モデル→プロンプト→ネガティブ→設定→生成」でOKで、うまくいかないときはプロンプト整理とSeed固定で少しずつ調整するのが近道です。

背景はlocationタグ、雰囲気寄せはポーション機能、崩れた部分はインペイントで直せるので、まずは短いプロンプトで1枚生成して調整してみてください!

実際に稼いでいる人の画像生成AIのスキルと収益化方法を知っていますか?

romptn ai が開催する完全無料のAIクリエイターセミナーでは、現場で活躍するプロから下記のような内容を学べます。

- ゼロから画像生成AIで収益化を達成するための具体的なロードマップ

- 実績のある講師が実践する初心者を脱出するための必須スキルと最新ツール

- Nano Banana や Grokなどスマホからでもできる本格的な画像生成AI活用方法

- 広告画像や映像など実際の制作過程をイメージするための講師によるライブデモ

2時間のオンラインセミナーで、ただ画像生成AIや動画生成AIの上級スキルや最新ツールを知るだけでなく、実際に収益化を達成する一歩を踏み出すための必須知識を学ぶことができます。

- 大手企業6社と契約実績(TOYOTA, mercari, 伊藤園 等)

- AI映画制作3本、WORLD AI FILM FESTIVAL 2026 in KYOTO にて2冠達成

- Best AI Anime 受賞

- Japan Best AI Film(グランプリ)受賞(応募431作品中)

- 経歴:元WEBデザイナー・マーケター → 2023年に生成AIと出会い転身 → プロのAIクリエイターへ