便利で日常生活の役に立つChatGPTですが、情報漏洩リスクがあることをご存知でしょうか?

ChatGPTの利用に慣れ、業務や副業など、発展的な利用を検討している方にとって、このリスクはしっかりと知っておきたいトピックでしょう。

この記事では、ChatGPTの情報漏洩リスクと実際の事例をふまえて、効果的な対策まで解説していきます。ぜひ最後までご覧ください。

📖この記事のポイント

- ChatGPTの情報漏洩リスクは、入力内容・バグ・詐欺が主な原因

- チャット履歴やパスワード、クレジットカード情報が漏れるおそれがある

- 個人情報や機密情報をチャットに入力しないことが最も重要な対策!

- 仕事や副業でChatGPTを使う際は、送信する情報は特に慎重に!

- 情報漏洩被害に遭わないために、AIの正しい使い方を知ろう!

- たった2時間の無料セミナーで会社に依存しない働き方&AIスキルを身につけられる!

- 今すぐ申し込めば、すぐに月収10万円UPを目指すための超有料級の12大特典も無料でもらえる!

\ 累計受講者10万人突破 /

無料特典を今すぐ受け取るChatGPTの利用には情報漏洩リスクがある

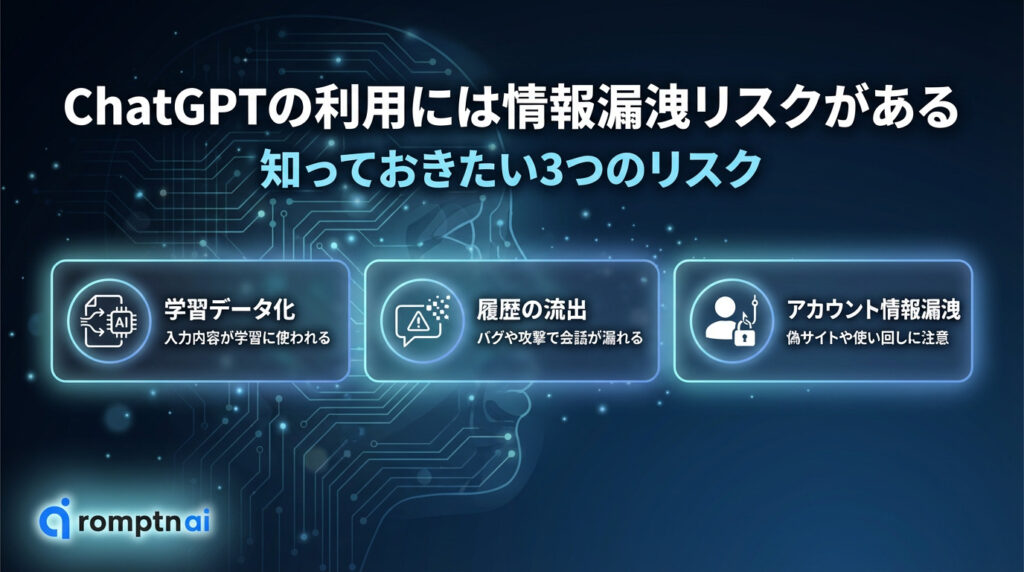

ChatGPTでの情報漏洩は、どのようなきっかけで起こるのでしょうか?

漏洩リスクは主に3つの原因に分類できます。

リスク①入力した情報が学習データに使われる

個人向けのChatGPTでは、初期設定のままだと、入力した内容がChatGPTの学習データとして利用される場合があります(設定からオフに変更可能です)。一方で、ビジネス向けプランでは原則として学習には利用されません。

プロンプトに個人情報や機密情報を入力すると、それらが学習用データに含まれてしまい、他のユーザーへの回答に利用され、情報が流出するリスクがあります。OpenAI側でも個人情報の削除やフィルタリングは行われていますが、「完全に情報が守られる」とまでは言い切れません。

そのため、流出すると困る情報は、そもそもプロンプトに貼り付けないことが重要です。

リスク②チャット履歴の流出

システムのバグやサイバー攻撃などが原因で、チャット履歴が第三者に見られてしまうリスクもあります。

以前、システムのバグにより、一部ユーザーのチャットのタイトルを他のユーザーが閲覧できる状態になってしまったことがあります。(現在は解消しています。)

このときはチャットのタイトルの流出が主でしたが、今後チャット内容の大規模な流出が起こる危険は十分にあります。

リスク③アカウント情報の漏洩

近年、偽サイトに誘導して個人情報を盗み出す「フィッシング詐欺」が増加しています。ChatGPTの偽サイトでメールアドレスやパスワードなどの情報を入力してしまうと、不正ログインによってアカウント情報が盗まれてしまうかもしれません。

ChatGPTで設定したパスワードを他のサイトでも使いまわしている場合には、他のサイトを装ったフィッシング詐欺でChatGPTのアカウント情報が盗まれることもあります。

過去には、OpenAI側のミスや、サイバー犯罪での流出も起きています。

不正ログインは、メールアドレスやパスワードだけでなく、クレジットカード情報やチャット履歴も流出してしまう危険のある、恐ろしい手口です。

過去に情報漏洩が起きた事例3選

ここからは、過去に情報の流出が起きた事例を3つ紹介します。

事例①機密情報の入力による情報漏洩

2023年3月、韓国のテクノロジー企業であるサムスンで起きた事例です。

社員のエンジニアが機密情報であるソースコードをChatGPTにアップロードして質問してしまい、情報が流出しました。

サムスンはこの件を受けて、最終的にChatGPTの利用を全面禁止にしました。

同様の事例が他の企業でも起きており、ChatGPTなどのチャットボットの利用を制限する企業が増えています。

事例②バグによるチャット履歴や個人情報の流出

先ほども少し紹介しましたが、ChatGPTでは以前、バグによって別のユーザーのチャット履歴のタイトルが表示される事態が生じました。それだけでなく、新規チャットの最初のメッセージが他ユーザーに表示されていた可能性もあります。

チャットのタイトルも、最初のメッセージも、プライバシー性の高い情報であることは確かです。

また同時期、ChatGPT Plus(有料プラン)加入者のうち一部ユーザーの支払い情報が漏洩したことも明らかになっています。情報の中には、氏名や住所、メールアドレス、クレジットカードの下4桁なども含まれていました。

事例③マルウェアによる個人情報の流出

シンガポールのセキュリティー企業「Group-IB」は、2023年5月までに、情報窃取マルウェアによって少なくとも10万件以上のChatGPTのアカウント情報が盗まれていることを報告しました。

盗まれた情報はダークウェブ(闇市場)で取引されています。一度流出した情報は削除が困難であり、詐欺やクレジットカードの不正利用など、被害が連鎖的に拡大するおそれが懸念されています。

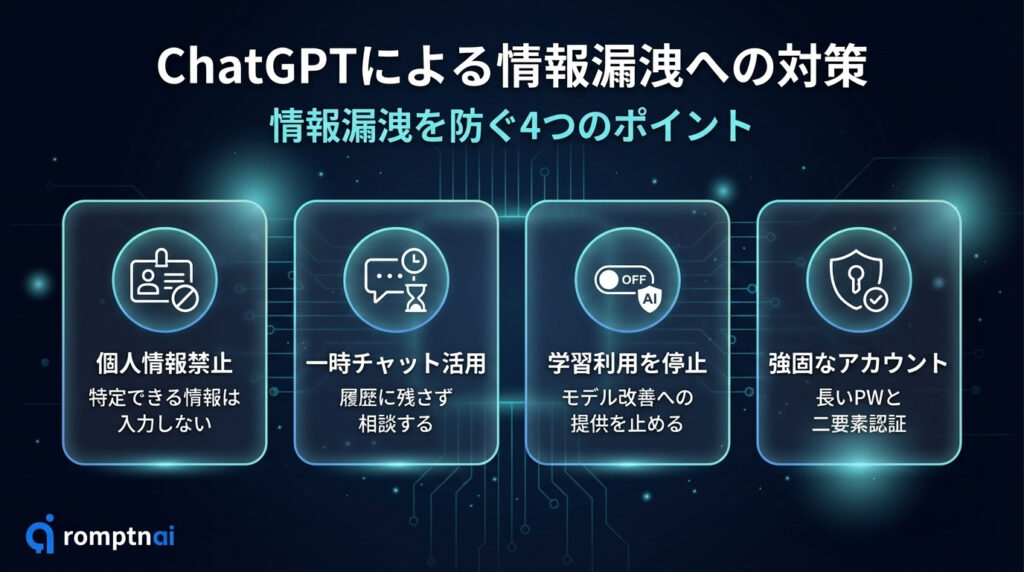

ChatGPTによる情報漏洩への対策

では、情報漏洩を防ぐために、または被害を最小限に抑えるために、どのような対策をとればいいのでしょうか?有効な対策は主に以下の4つです。

- 個人情報、機密情報を入力しない

- 一時チャットを利用する

- オプトアウトを行う

- アカウントのセキュリティを強化する

それぞれを詳しく解説します。

対策①個人情報・機密情報を入力しない

基本の対策ではありますが、最も効果のある方法です。

学習データに使われたり、不正ログインやバグなどで第三者に閲覧されたりしないよう、チャットに個人情報や機密情報が含まれるプロンプトを入力しないようにしてください。

どうしてもそのような情報が含まれる質問がしたい場合は、情報が特定される表現を避け、一般化したり抽象化したりして質問するとよいでしょう。

仕事でChatGPTを利用する際は「NG」の表現は避け、「OK」のような聞き方をすると安全です。

例1. 営業・顧客データ

NG:「〇〇株式会社の顧客リストを貼り付けます。売上の高い順に並べ替えて、上位50社の会社名と担当者名、メールアドレスを抜き出してください。」

OK:「下にサンプルの顧客データを載せます。このような表を、売上の高い順に並べ替えるExcelの操作手順と、便利な関数があれば教えてください。」

例2. エンジニア・開発(ソースコード)

NG:「自社サービスのログイン機能のソースコード(まだ非公開)を全て貼ります。セキュリティ上の問題がないかレビューしてください。」

OK:「ユーザー認証機能を作るにあたって、次のような構成を検討しています。

・メールアドレスとパスワードによるログイン

・2段階認証は、最初はメールコード、将来的に認証アプリも追加予定

このような構成で、セキュリティ上のよくある落とし穴や、追加したほうがよい対策があれば教えてください。」

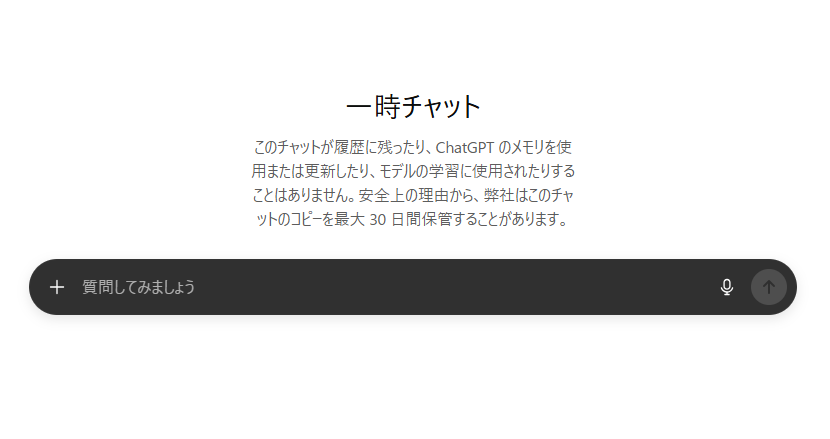

対策②一時チャットを利用する

ChatGPTには、「一時チャット」機能があります。一時チャット機能をオンにした状態でのチャットは、履歴に残ったり学習データに使用されたりすることはありません。

この機能をオンにする方法は簡単です。ブラウザ版、アプリ版問わず、新規チャットの作成画面の右上にある、下の画像のような点線の吹き出しアイコンを選択することで、一時チャットが利用できます。

一時チャット機能をオンにしても、OpenAI側にチャットのコピーが最大30日間保存されることがあります。情報漏洩被害を確実に防ぐためには、個人情報を入力しない努力は別途必要です。

対策③オプトアウトを行う

ChatGPTのオプトアウトとは、ユーザーが入力したチャットの内容を、AIモデルの改善や学習に使わせないようにする設定のことです。

この設定を行えば、ChatGPTでのチャット内容は常に学習データに使われないことになります。

設定方法は簡単です。以下、PCブラウザ版とスマホアプリ版に分けて解説します。

PCブラウザ版の場合

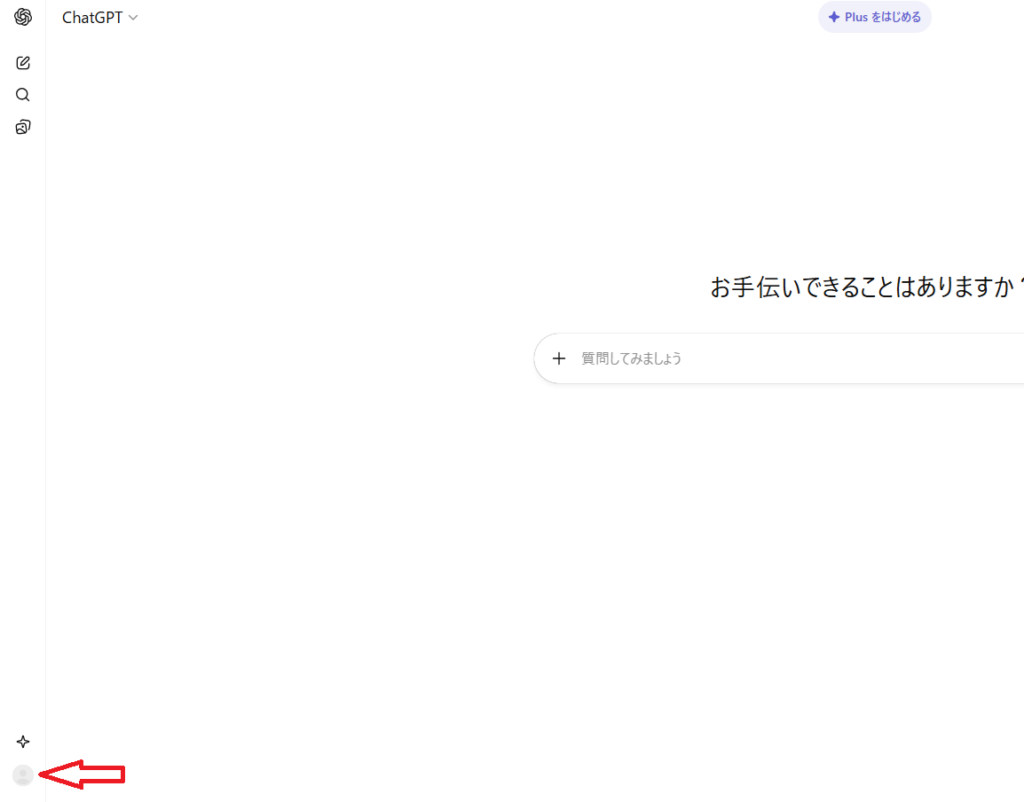

①画面左下のアカウントのアイコンをタップする

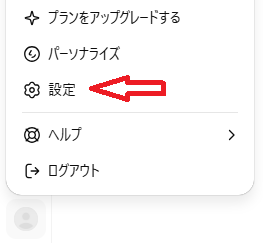

②「設定」を開く

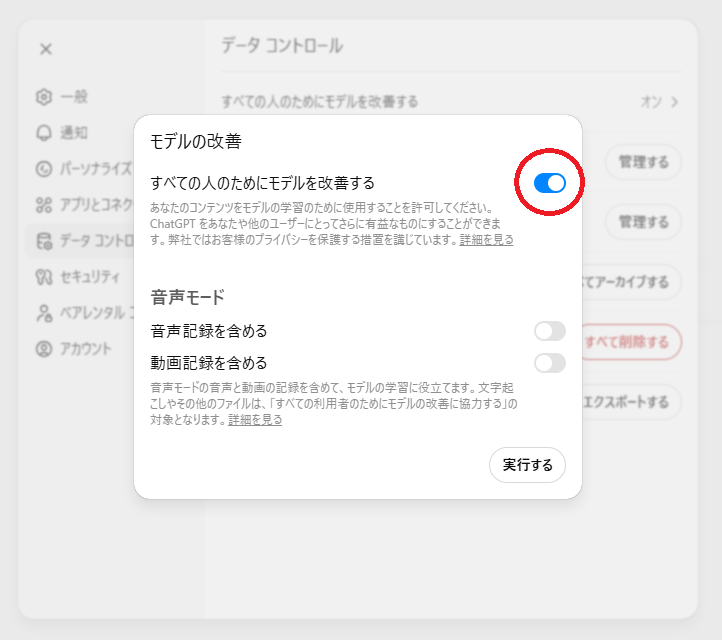

③「データ コントロール」の「すべての人のためにモデルを改善する」を開く

④一番上のスイッチをオフにする

以上で設定は完了です!

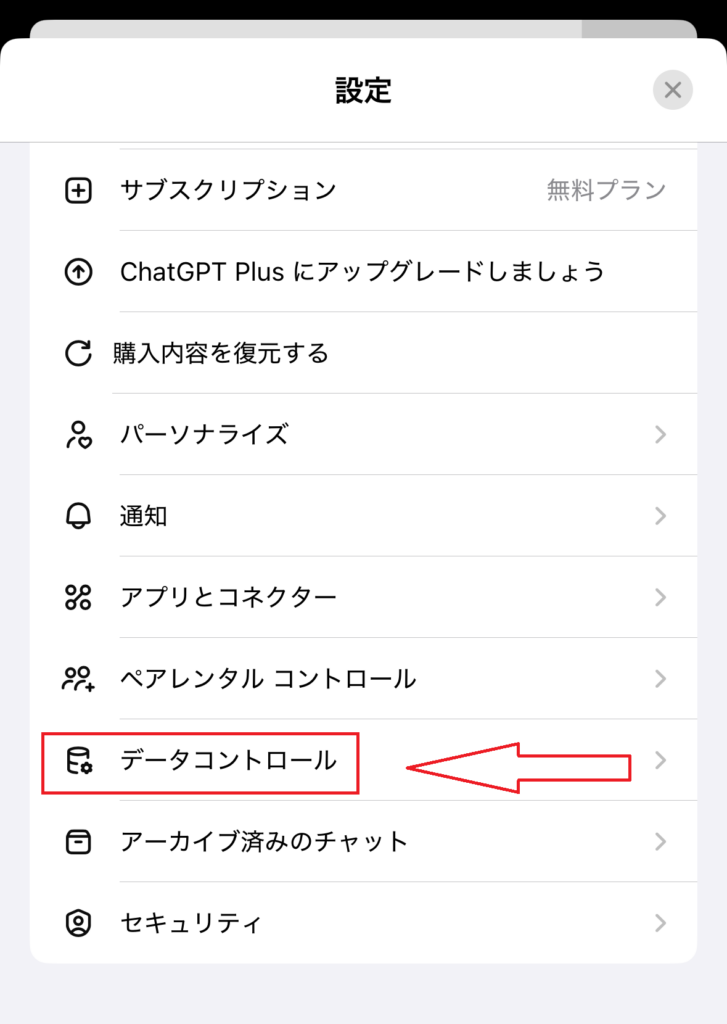

スマホアプリ版の場合

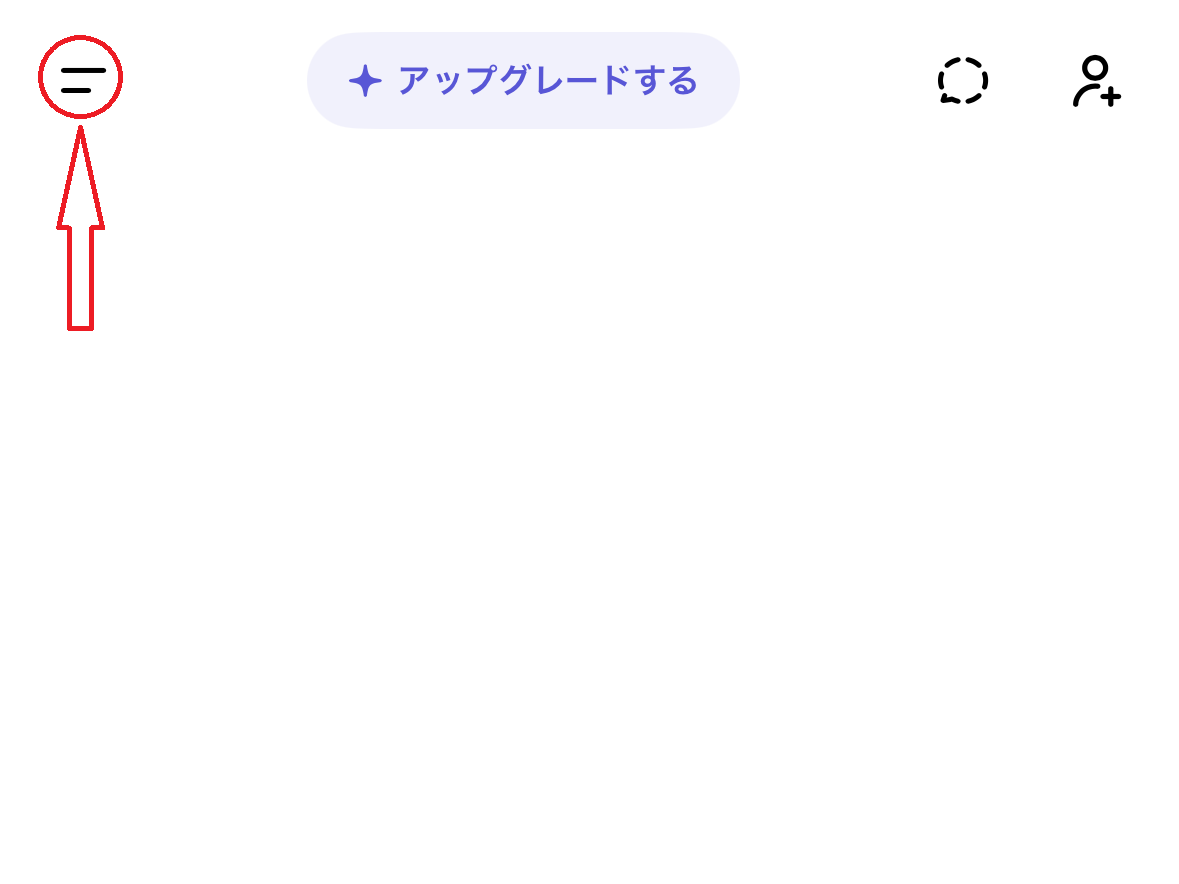

①アプリを開き、左上の2本線のアイコンをクリック

②サイドバー下部の、アカウントのアイコンをタップし、設定を開く

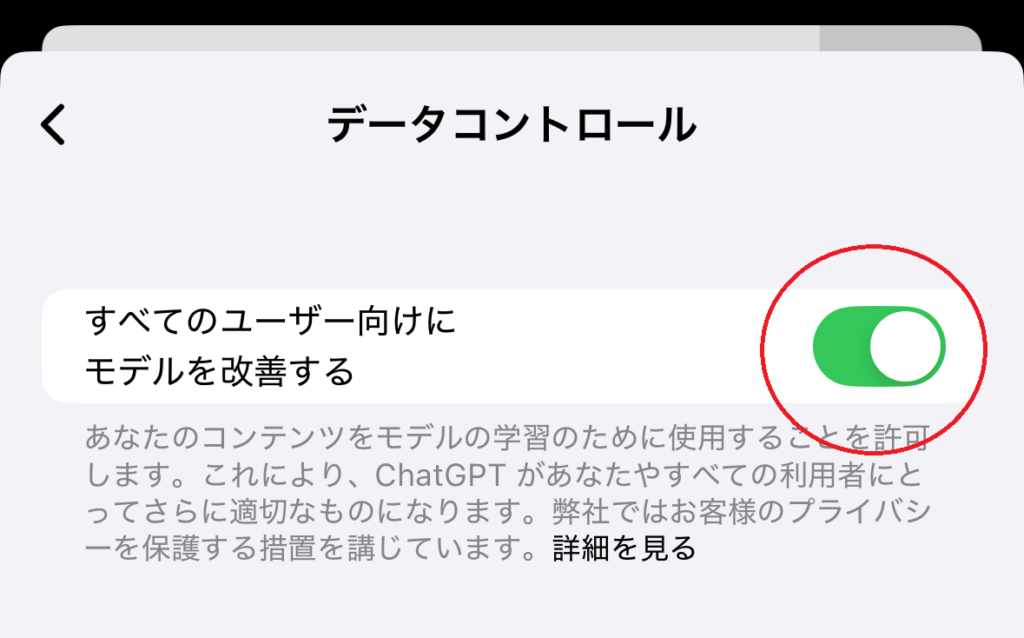

③「データコントロール」を選択

④「すべてのユーザー向けにモデルを改善する」をオフにする

これで完了です!

オプトアウトをしても、チャットの通常通り保存されます。そのため、個人情報を入力しない努力は別途必要です。

また、オプトアウトにはデメリットもあります。それは、モデル改善への貢献が減ることです。

オプトアウトをすると、あなたとの会話内容は今後のモデル改良のための学習データには使われません。その分だけ、「多くのユーザーの会話をもとに少しずつ賢くなっていく」というプロセスに、あなたのデータが活かされなくなります。

プライバシーをどこまで優先したいか、モデル改善への協力をどこまで許容するかを踏まえて、自分に合った設定を選びましょう。

対策④アカウントのセキュリティを強化する

不正ログインやフィッシング詐欺を防ぐために、セキュリティを強化するのも効果的です。

より強力なパスワードへの変更、パスワードを使い回さない、二段階認証の導入など、ご自身に合った方法を実践してみてください。

総務省は、安全なパスワードの指針として、

- 10文字以上の文字数

- ランダムな英数字の並び

- 数字や記号、アルファベット(大文字、小文字)が混ざっている

- パスワード自動生成機能で作られたパスワードを使う

などを提案しています。ぜひ参考にしてください。

仕事・副業でChatGPTを安全に使うチェックリスト

ここまで紹介したリスクと対策を踏まえ、「結局、仕事や副業でどこまでChatGPTを使っていいのか?」という疑問に答えるチェックリストを用意しました。

次のような情報は、Free/Plusなどの一般向けChatGPTには入力しないのが基本です。該当するものがないか、簡単にチェックしてみてください。

機密性の高い情報は、匿名化・要約・仮のデータへの置き換えなどで「個人や会社が特定されない形」に変えてから相談するのがおすすめです。

- すでに一般公開されている情報の要約・改善をお願いする

- ダミーのサンプルデータを作って「分析のやり方」や「Excel関数の組み方」を教えてもらう

- 文書の「骨組み」だけを書いてもらい、具体的な数字や固有名詞は自分で後から埋める

このように、「具体的な中身や固有名詞は自分の手元に残し、考え方や型、言い回しを手伝ってもらう」という使い方であれば、仕事や副業でも比較的安全に活用しやすくなります。

社外の第三者への提供を禁止されている情報かどうか事前に確認し、少しでも不安なら入力しない方がよいでしょう。必要に応じて上司や情報システム部門に相談することがおすすめです。

機密性の高いデータを本格的に扱う場合は、ChatGPT Enterprise(法人向けプラン)や社内向けのクローズドなAI環境の利用を検討してみてください。

まとめ

この記事ではChatGPTの情報漏洩リスクについて解説してきました。

まとめると、このようなポイントになります。

- ChatGPTでの情報漏洩で懸念されるリスクは主に3つ。

- 入力した個人情報などが学習データに利用される

- バグによるチャット履歴やアカウント情報の流出

- フィッシングやマルウェアなどサイバー攻撃などによる個人情報の流出

- 過去には情報漏洩が起きた事例が確認されている

- 情報漏洩を防ぐ対策は以下の通り

- 個人情報などを入力しない

- 一時チャット機能を利用する

- オプトアウト設定を行う

- パスワードの強化、二段階認証の設定を行う

- 仕事などでChatGPTを使う際は、機密情報を含むプロンプトでないか確認する

リスクをしっかり理解して、安全にChatGPTを利用しましょう!

romptn ai厳選のおすすめ無料AIセミナーでは、AIの勉強法に不安を感じている方に向けた内容でオンラインセミナーを開催しています。

AIを使った副業の始め方や、収入を得るまでのロードマップについて解説しているほか、受講者の方には、ここでしか手に入らないおすすめのプロンプト集などの特典もプレゼント中です。

AIについて効率的に学ぶ方法や、業務での活用に関心がある方は、ぜひご参加ください。

\累計受講者10万人突破/