OpenAIが2025年4月16日に発表した新モデル「o3」と「o4-mini」は、AIの思考能力を大きく飛躍させました!

今までのAIが質問にすぐ答えるのに対し、この新モデルは「立ち止まって考える」ことで、より複雑な問題を解決できるのが特徴です。

この記事では、誰でもわかりやすいように、o3とo4-miniの特徴や性能、使い方から実践的な活用例まで徹底解説します!

- OpenAIの思考型モデル「oシリーズ」とは

- o3/o4-miniモデルの特徴と性能

- o3とo4-miniの料金プラン

- 新しい実験的ツール「Codex CLI」の発表について

OpenAIの思考型モデル「oシリーズ」とは

思考型モデルとは、質問に対してすぐに回答を生成するのではなく、回答する前に「考える時間」を持つAIモデルのことです。人間が複雑な問題に直面したときに「ちょっと考えてみるか」と頭をひねるように、AIも段階的に問題を分析し、論理的な推論を行うことができるようになりました。

OpenAIの思考型モデルは、以下のような進化を遂げてきました。

- 2024年9月:初の思考型モデル「O1」発表

- 2024年12月:小型版「O1-mini」登場

- 2025年2月:改良版「o3-mini」発表

- 2025年4月:最新版「o3」と「o4-mini」発表

この進化により、AIの推論能力は飛躍的に向上し、複雑な問題にも対応できるようになってきています!

o3モデルの特徴と性能

o3は、OpenAI史上最も高性能な思考モデルとして登場しました。以前のトップモデルだったO1を上回る性能を持ち、特定の分野では人間レベルの推論能力を発揮します。

o3の主な特徴は、以下の通りです。

- 優れた推論能力:複雑な問題を段階的に解決する能力が大幅に向上

- 画像を使った思考:ホワイトボードや手書きの図表も理解して分析

- ツール統合機能:Web検索、データ分析、画像生成などのツールを連携して使用可能

- 低コスト化:O1より低コストで高性能(入力コスト33%減、出力コスト33%減)

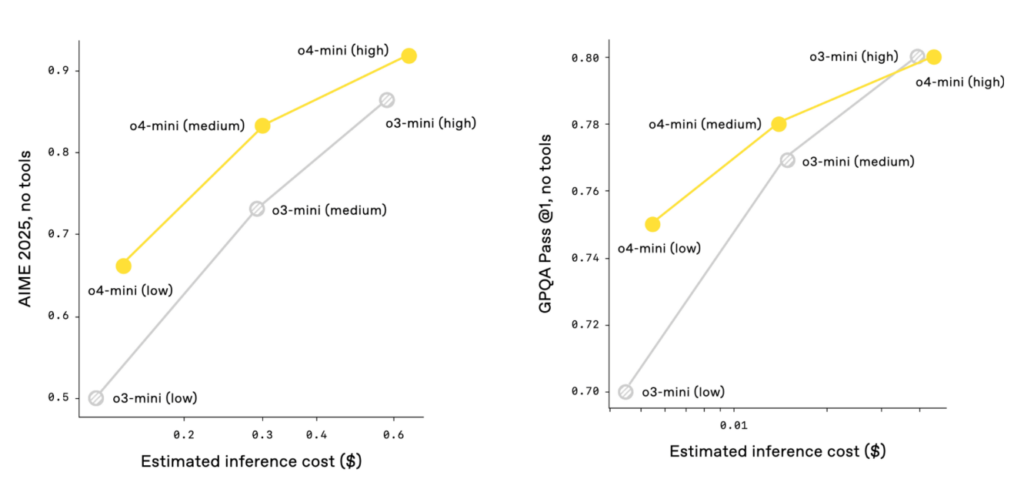

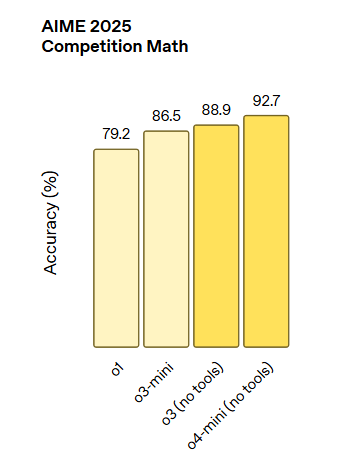

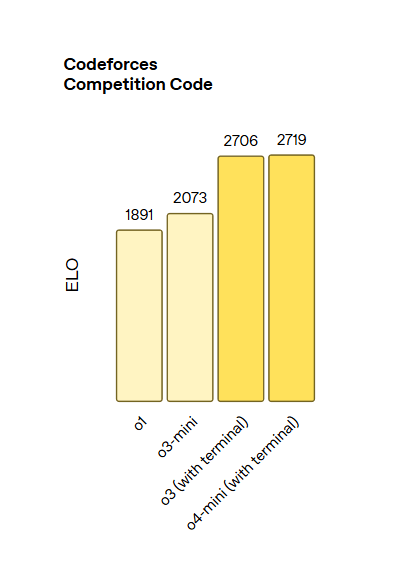

そして、o3は様々なベンチマークテストで優れた成績を収めています。

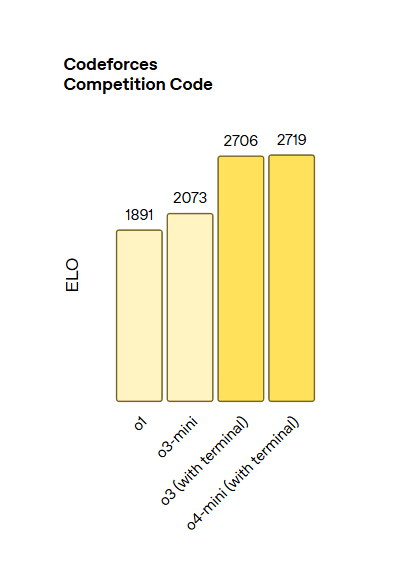

- Codeforces(コーディング):ELO 2706点を達成

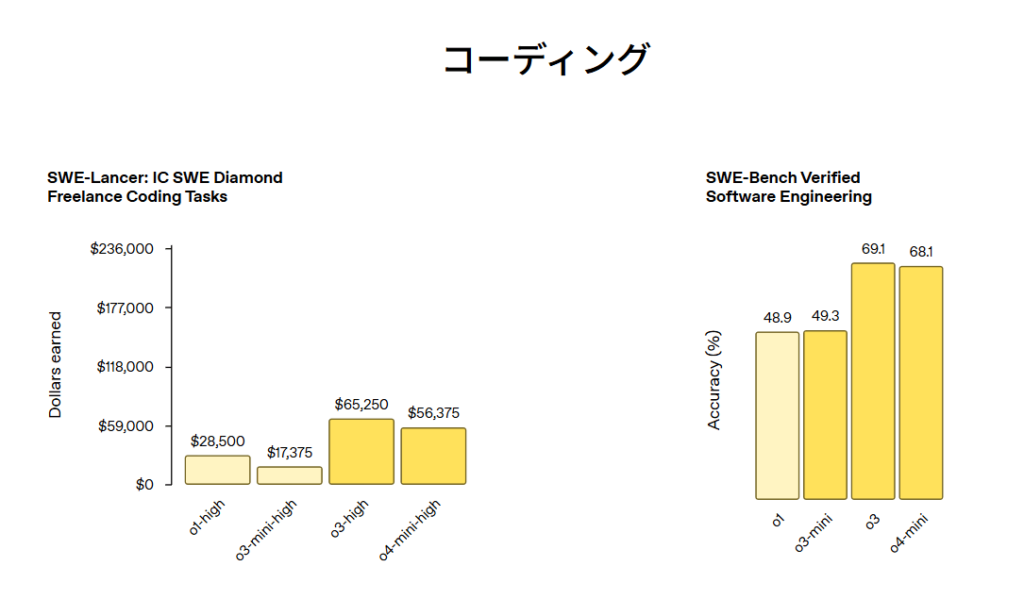

- SWE-bench(ソフトウェア工学):69.1%の正解率

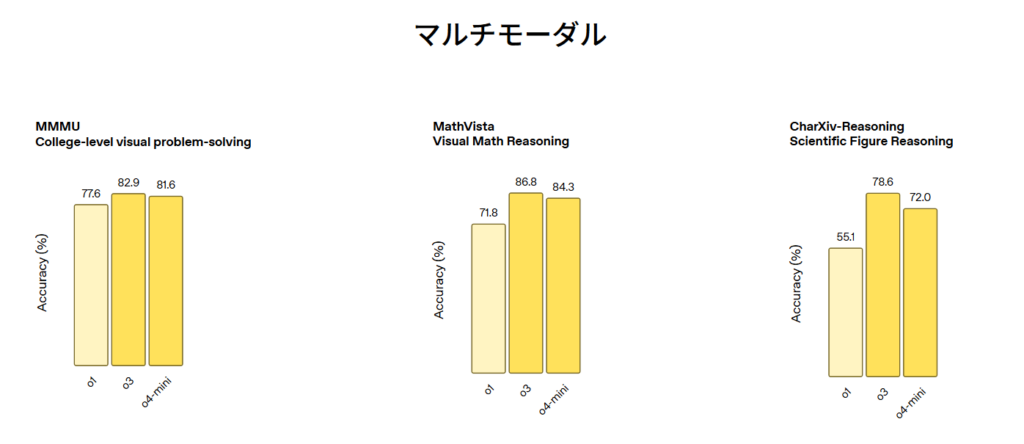

- MMMU(マルチモーダル問題解決):82.9%の正解率

- 専門家評価:O1と比較して重大なエラーが20%減少

これらの数値は、o3の思考能力が従来のAIを大きく上回ることを示しています!

o4-miniモデルの特徴と性能

o4-miniは、小型ながら驚くべき性能を発揮する、コスト効率に優れたモデルです。特にスピードと経済性を重視するユーザーにおすすめのモデルとなっています。

o4-miniの主な特徴は、以下の通りです。

- 高速応答:o3より速い処理速度でリアルタイム対話に最適

- コスト効率:o3-miniと同じ価格でより高い性能を実現

- 特定分野での高性能:特に数学、コーディング、視覚タスクで優れた能力を発揮

- 高い利用上限:o3より大幅に高い使用制限をサポート

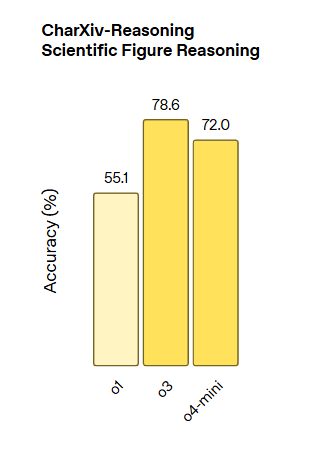

そして、o4-miniも小型モデルながら様々なベンチマークテストで優れた成績を収めています。

- AIME 2025(数学):Python環境と組み合わせて99.5%の正解率

- Codeforces(コーディング):ELO 2719点を達成

- CharXiv-Reasoning(科学図表理解):72.0%の正解率

- 専門家評価:非STEM分野やデータサイエンスでo3-miniを上回る性能

特に数学分野での99.5%という数値は、ほぼ完璧な解答能力を示しており、いままでの小型モデルの常識を覆す結果となっています!

o3とo4-miniの特徴①:画像で考えるAI

o3とo4-miniの最も革新的だと言われている機能の一つが「画像で思考する」能力です。これまでのAIは画像を認識するだけでしたが、新モデルは画像を思考する過程に組み込むことができます!

新モデルは以下のような画像関連タスクを実行できます。

- ホワイトボード解析:会議でのホワイトボード内容を理解し整理

- 手書きメモの処理:手書きメモを理解し、デジタル化や改善提案

- 図表の解析:グラフやチャートを理解し、分析や改善案を提示

- 画像操作と修正:画像の回転、拡大、トリミングなどを自動実行

例えば、反転した手書きノートの写真をアップロードすると、自動的に正しい向きに回転させて内容を解読するといったことも可能になりました。

Xでは、こんなポストもありました。

場所も簡単に解析できてしまうなんてすごいですね…!

そして、画像理解の機能は以下のようなことに使えるだろうとされています。

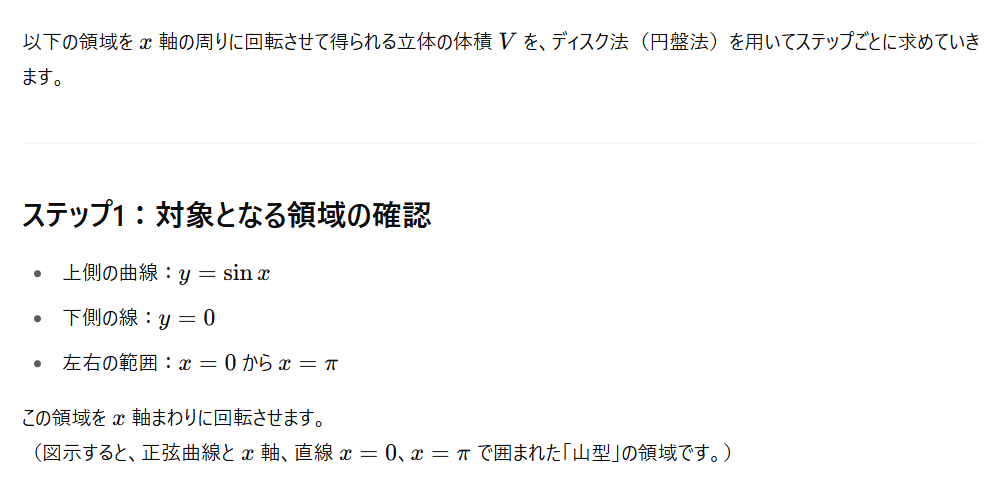

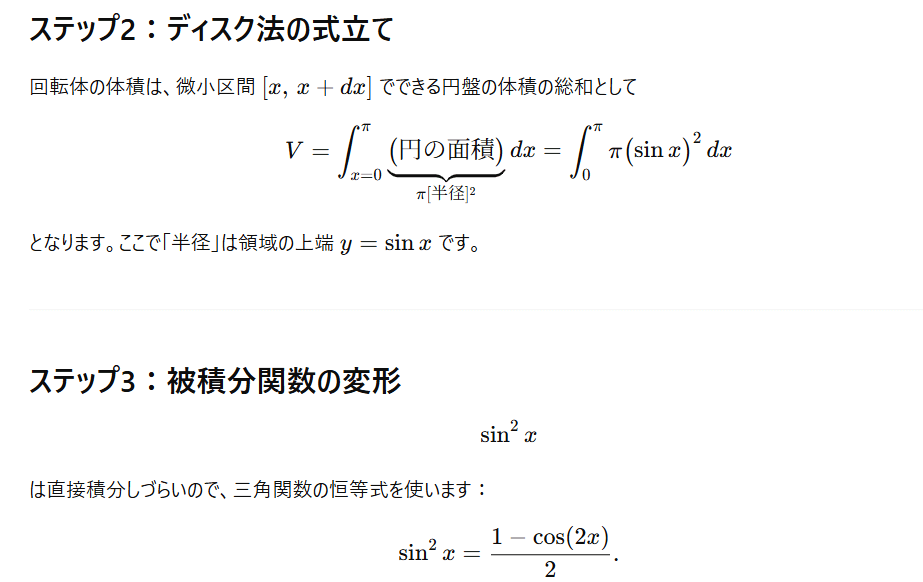

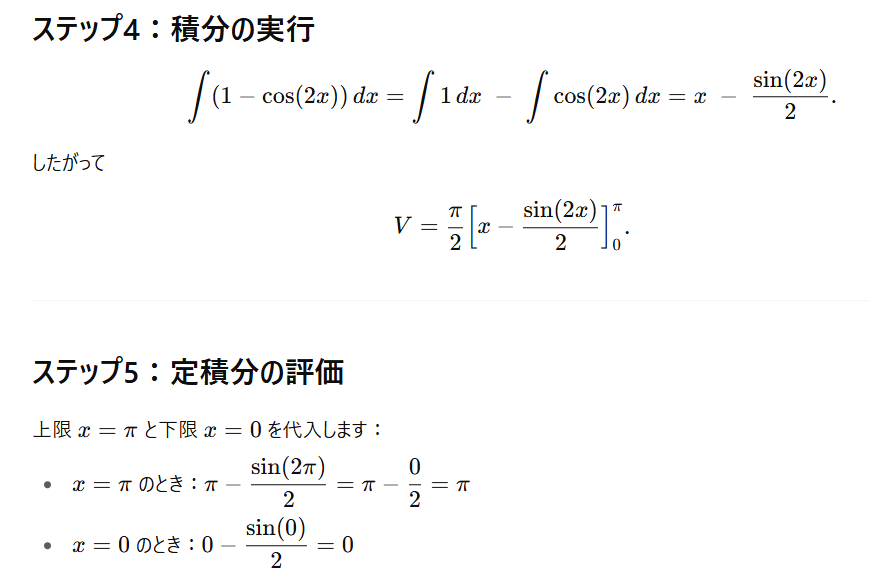

- 学習のサポート:数学の問題を写真で撮影するだけでステップごとの解説を受けられる

- デバッグ:エラー画面のスクリーンショットから問題点を特定して解決策を提案

- 文書処理:手書き文書や図表を理解してデジタル化や要約を行う

- 設計のサポート:手描きのスケッチからデザイン改善案を提案

この機能によって、AIとのコミュニケーションがより簡単で効率的になりますね!

o3とo4-miniの特徴②:AIエージェント機能

そして、o3とo4-miniはChatGPTの以下のようなすべてのツールを自動的に使用・連携できるようにもなりました!

- Web検索:インターネット上の最新情報を収集・分析

- データ分析:Pythonを使用してアップロードされたファイルやデータを分析

- 画像生成:テキスト指示に基づいて画像を生成

- 視覚推論:アップロードされた画像を分析・理解

- メモリ機能:過去の会話内容を参照して文脈を理解

これらのツールを連携させることで、1つのツールでは解決できなかった複雑なタスクにも対応できるようになりました。

このツール連携機能をどんな場面で使えるかと言うと、こんな場面で使えます。

- 調査レポートの作成:Web検索で情報収集→Pythonでデータ分析→結果を図表で視覚化

- プロジェクトの計画作成:過去の会話を参照→最新情報の検索→データ分析→提案作成

- 学術研究のサポート:論文の分析→関連研究の検索→データの統計分析→結果の視覚化

特に、これらのツールをいつどのように使うかをAI自身が判断できるようになった点が大きいですね。

o3とo4-miniの料金プラン

o3とo4-miniは、2025年4月16日からChatGPTの有料プラン向けに提供が開始されました。

- ChatGPT Plus/Pro/Team:2025年4月16日から即時利用可能

- ChatGPT Enterprise/Edu:2025年4月24日から利用可能

- ChatGPT 無料版:o4-miniのみ試用可能(「Think(推論)」ボタンを使用)

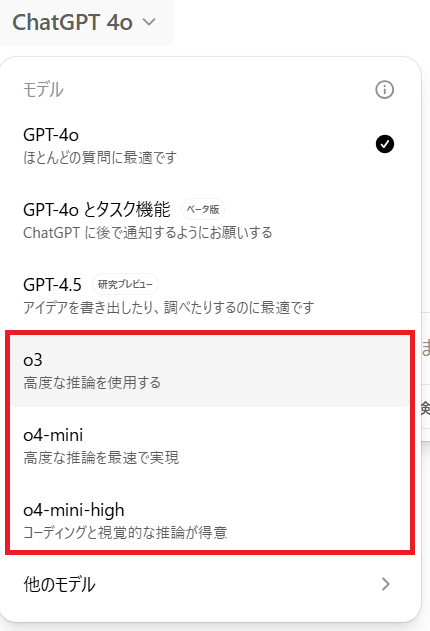

モデル選択画面では、これまでのO1、o3-mini、o3-mini-highに代わって、o3、o4-mini、o4-mini-highが表示されるようになっています。

o3とo4-miniのAPI利用の料金プラン

開発者向けのAPI料金は以下の通りです。

| 入力 | 出力 | |

|---|---|---|

| o3 | $10.00 / 1M トークン (O1の$15.00から33%減) | $40.00 / 1M トークン (O1の$60.00から33%減) |

| o4-mini | $1.10 / 1M トークン (o3-miniと同額) | 出力: $3.50 / 1M トークン (o3-miniと同額) |

通常のChat Completions APIとResponses APIを通じて両モデルにアクセスできます!

どのモデルを使うか迷う場合は、以下を参考にしてみてください!

- o3:複雑な問題解決、画像理解、高精度が必要な場合

- o4-mini:コスト効率重視、数学・コーディング問題、素早い回答が必要な場合

- o3-pro:数週間以内にリリース予定の最上位モデル(現時点ではo1-proが引き続き利用可能)

ChatGPTでのo3/o4-miniの使い方

新モデルを実際に使ってみたい方のために、基本的な使い方を紹介します!

有料プランでの利用方法

- ChatGPTにログインし、画面左上のモデル選択メニューから「o3」または「o4-mini」を選択

- 通常のチャットと同様に質問や指示を入力

高度な推論を活用するためのコツは、以下を意識してみましょう!

- 複雑な問題は詳細に説明すると良い結果が得られます

- 「じっくり考えて」と指示すると、より深い思考が得られます

- 画像をアップロードする場合は、分析してほしいポイントを明確に指示しましょう

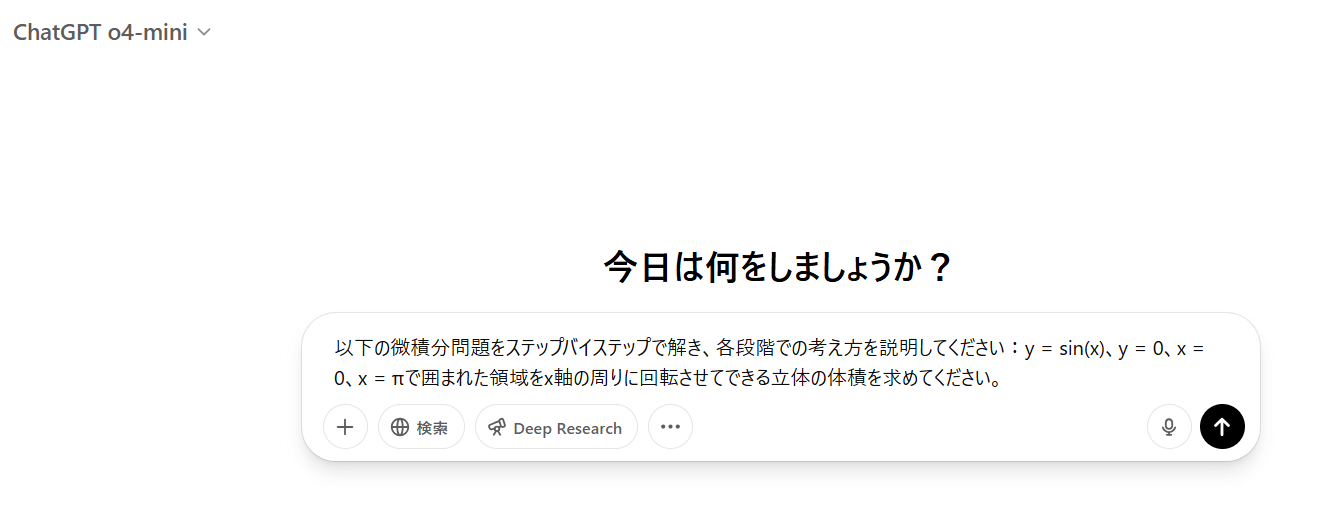

すると、下記のような感じで分かりやすく回答してくれます!

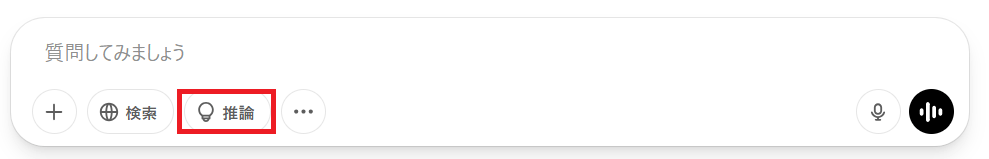

無料版での試用方法

- ChatGPTの無料版にログインして、テキストエリアの上にある「Think(推論)」ボタンを選択

- o4-miniの機能を限定的ですが試すことができます!

APIでの利用方法

開発者の方は以下の手順でAPIから利用できます。

from openai import OpenAI

client = OpenAI(api_key="your-api-key")

response = client.chat.completions.create(

model="o3", # または "o4-mini"

messages=[

{"role": "system", "content": "あなたは役立つアシスタントです。"},

{"role": "user", "content": "複雑な数学の問題を解いてください:..."}

]

)これらの基本的な使い方を覚えておくと、新モデルの能力を最大限に活用できるでしょう。

※ChatGPTでAPIを利用する場合は、下記記事を参考にしてみてください!

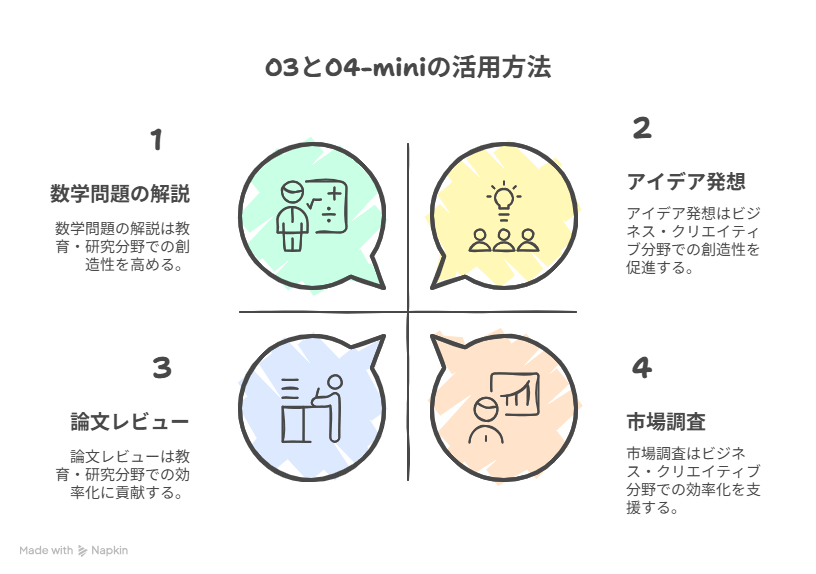

o3とo4-miniの活用方法

では、o3とo4-miniはどのような場面で活用できるのでしょうか?具体例をいくつか紹介します。

①教育・研究分野での活用

- 数学問題の解説:複雑な数式も段階的に解説(特にo4-miniは数学に強み)

- 論文のレビュー:研究論文の要点抽出や課題の特定

- 実験データの:実験結果の解析とグラフ化、考察の提案

- 学習計画の作成:個別最適化された学習プランの提案

②コーディング・開発支援

- コード生成:要件に基づいた効率的なコードの提案

- デバッグ支援:エラーの原因特定と解決策の提示

- コードの最適化:既存コードの効率化や改良提案

- アーキテクチャ設計:システム設計のサポートや評価

③ビジネスでの活用

- 市場調査:最新のWeb情報とデータ分析を組み合わせた市場分析

- 財務分析:財務データの視覚化と傾向分析、予測モデル作成

- 戦略企画:多角的な情報分析に基づく戦略オプションの評価

- プレゼン作成:データ分析結果を視覚的に魅力的な形で提示

④クリエイティブな活用

- アイデア発想:様々な視点からの創造的なアイデア提案

- コンテンツの企画:トレンド分析を踏まえたコンテンツ企画立案

- デザイン提案:手描きスケッチからの改善案や発展アイデア提示

- ストーリー構築:複雑なプロットや設定の整合性チェック

これらの活用方法を通じて、o3とo4-miniはさまざまな分野での効率化ができますのでぜひ試してみてください!

o3とo4-miniの安全性と注意点

OpenAIは、生物学的脅威・マルウェア生成・ジェイルブレイクなどへの対策を強化したり、リスクモニタリングシステムという推論LLMによる危険なプロンプトの検出率が約99%に向上させたりとo3とo4-miniどちらの安全性強化にも力を入れています。

しかし、いくつか制限もあるので確認しておきましょう!

- 処理時間:「考える」ため、即時応答が必要な場合には不向き

- 費用:特にo3は高性能ながら相応のコストがかかる

- 知識の限界:トレーニングカットオフ後の最新情報には限界がある

- 幻覚の可能性:確率的生成のため、完全に正確とは限らない

これらの制限を理解した上で、適切に活用することが重要です。

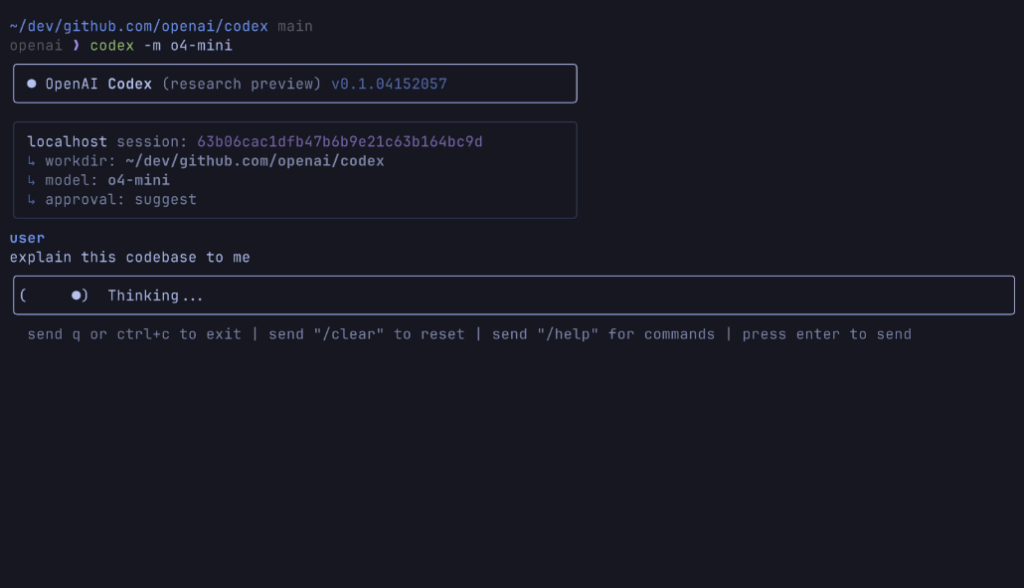

新しい実験的ツール「Codex CLI」も発表

OpenAIは新モデルと一緒に、新しい実験的ツール「Codex CLI」も発表しました。これはターミナルから直接利用できる軽量コーディングアシスタントです。

Codex CLIの特徴は、以下の通りです。

- ターミナルの統合:コンピューター上で直接動作するコマンドラインツール

- マルチモーダルに対応:スクリーンショットやスケッチをモデルに渡せる

- ローカルコードとの連携:ローカルファイルにアクセスして直接操作可能

- オープンソース:完全にオープンソースで、誰でも利用・改良可能

コード生成・デバッグのサポート・システム操作・ファイルの処理などで利用できるツールです。コードや画像を通じた直接的なコミュニケーションが出来るので、より効率的な開発作業が可能になります!

まとめ

いかがでしたでしょうか?

OpenAIの新モデルo3とo4-miniの概要・性能・使い方・料金プランなどを詳しく解説してきました!

この記事で紹介したことをまとめると次のようになります。

- o3は最高性能の思考モデルで、複雑な問題解決や画像理解に優れている

- o4-miniは小型ながら特に数学・コーディングで優れ、コスト効率が高い

- 両モデルは画像を使った思考やツール連携など新しい機能を備える

- ChatGPTの有料プランで即時利用可能(無料プランではo4-miniのみ試用可)

AIの進化は日々加速しており、o3とo4-miniの登場はその一里塚に過ぎません。これからのAI開発の方向性を示す重要な節目として、今後の展開にも注目していきたいところです!

romptn ai厳選のおすすめ無料AIセミナーでは、AIの勉強法に不安を感じている方に向けた内容でオンラインセミナーを開催しています。

AIを使った副業の始め方や、収入を得るまでのロードマップについて解説しているほか、受講者の方には、ここでしか手に入らないおすすめのプロンプト集などの特典もプレゼント中です。

AIについて効率的に学ぶ方法や、業務での活用に関心がある方は、ぜひご参加ください。

\累計受講者10万人突破/