最近話題のAI画像生成ツールですが、生成時間が長くて待ちきれないという方も多いのではないでしょうか。特にSDXLモデルは高品質な画像を生成できる反面、処理時間が長いという課題がありました。

そんな悩みを解決するのが、ByteDance(TikTok開発元)が開発した「SDXL Lightning」です!通常のモデルでは20ステップ程度必要だった処理が、なんと2〜8ステップという少ないステップ数で高品質な画像を生成できるようになりました。

この記事では、SDXL Lightningの基本知識から導入方法、効果的な使い方まで初心者にもわかりやすく解説していきます。画像生成の作業効率を大幅に向上させたい方は必見です!

- SDXL Lightningとは?

- SDXL Lightningの導入方法

- SDXL Lightning LoRAの使い方

- SDXL LightningとSDXL Turboとの違い

※Stable Diffusionの基本的な使い方については、下記記事で詳しく解説しています!

内容をまとめると…

SDXL LightningはByteDanceが開発した高速画像生成モデルで、通常20ステップ必要な処理をわずか2〜8ステップで実行できる

蒸留(distillation)技術により、8ステップモデルでも約4秒で1024×1024の高解像度画像を生成可能

LoRA版を使えばお気に入りのSDXLモデルと組み合わせて高速化でき、ComfyUI・WebUI・Forgeいずれでも利用できる

実用的な画質を求めるなら4step以上、こだわるなら8stepモデル一択で、SDXL Turboより細部のディテールに優れる

きれいな画像を作れるようになっただけで、収益化できずに止まってませんか?

romptn ai では、実際に画像生成AIで稼いでいるプロを講師に招いた完全無料のAIクリエイターセミナーを開催しています。

2時間のオンラインセミナーで、実際に稼いでいる人が使う最新画像生成AIツールや上級者にステップアップするための必須スキルなどの知識面はもちろんのこと、ゼロから収益化を実現するための具体的なロードマップを体験談ベースで詳しく学ぶことができます。

また、豪華な無料参加特典も用意していますので、ぜひご興味を持った方はお気軽に下記のボタンから詳細をチェックしてみてください!

\ 現役の画像生成AIのプロから学べる! /

無料セミナーの詳細をみるSDXL Lightningとは?

SDXL Lightningは、ByteDanceが開発した高速画像生成モデルです。通常のStable Diffusion XL(SDXL)では多くのステップ数を要していた画像生成を、わずか1〜8ステップという少ないステップ数で高品質な画像を生成できる技術です。

特に「蒸留(distillation)技術」を活用することで、従来のモデルと比較して処理速度を大幅に向上させています。例えば8ステップモデルでも、わずか4秒程度で1024×1024の高解像度画像を生成可能です!

さらにSDXL Lightningは、stabilityaiの「stable-diffusion-xl-base-1.0」をベースに構築されているため、SDXLの高画質を保ちつつ高速化を実現しています。

SDXL Lightningの特徴と主要なモデル

SDXL Lightningの最大の特徴は、少ないステップ数でも高品質な画像を生成できる点です。この特徴によって、画像生成の作業効率が飛躍的に向上します。

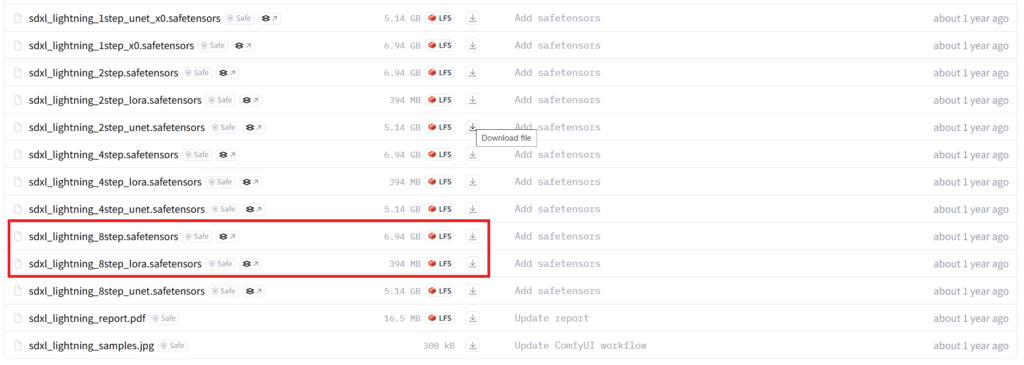

提供されているモデル一覧

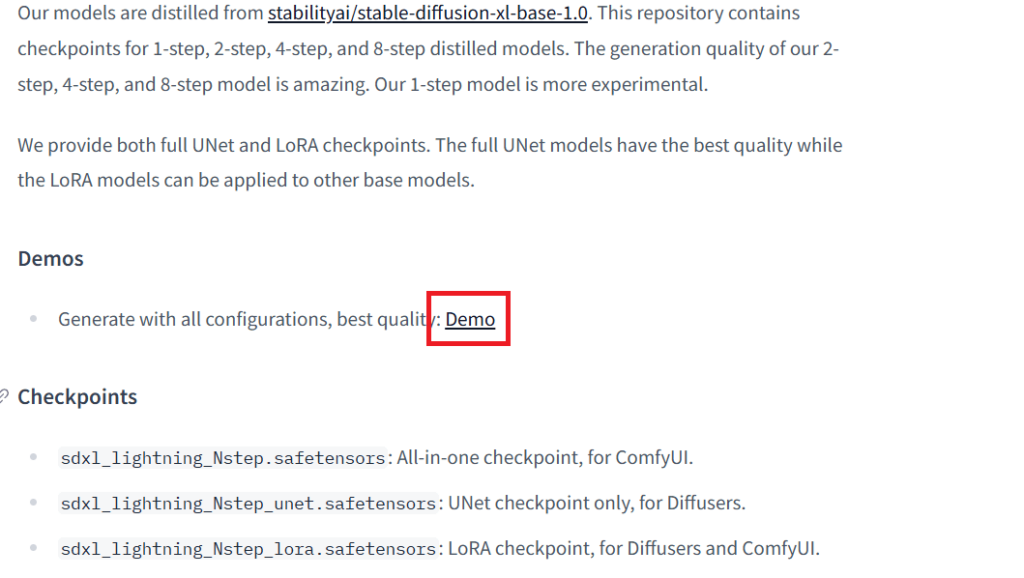

Hugging Faceで公開されているSDXL Lightningのモデルは、ステップ数別に以下の4種類があります。

- sdxl_lightning_1step_x0.safetensors:実験的な1ステップモデル

- sdxl_lightning_2step.safetensors:2ステップモデル

- sdxl_lightning_4step.safetensors:4ステップモデル

- sdxl_lightning_8step.safetensors:8ステップモデル

- sdxl_lightning_8step_lora.safetensors:LoRAバージョン(他のSDXLモデルと組み合わせ可能)

公式の説明によると、1ステップモデルは実験的なものとされており、実用的には2ステップ以降のモデルが推奨されています。特に8ステップモデルは画質と速度のバランスに優れており、最もおすすめです。

また、LoRAバージョンも提供されており、お気に入りのSDXLモデルと組み合わせて使用することも可能です。

SDXL Lightningの導入方法

ここからは、SDXL Lightningを実際に導入する方法を解説します。利用方法は主に以下の3つがあります。

- ローカル環境でComfyUIを使用する方法

- Google ColabでComfyUIを使用する方法

- WebUIやForgeで使用する方法(sdxl_lightning_8step_loraの場合)

それぞれの方法について詳しく見ていきましょう。

ローカル環境に導入する方法

まずは、Hugging Faceから必要なモデルファイルをダウンロードします。

①ByteDance/SDXL-Lightningにアクセス

②使用したいモデル(おすすめは「sdxl_lightning_8step.safetensors」と「sdxl_lightning_8step_lora.safetensors」)をダウンロード

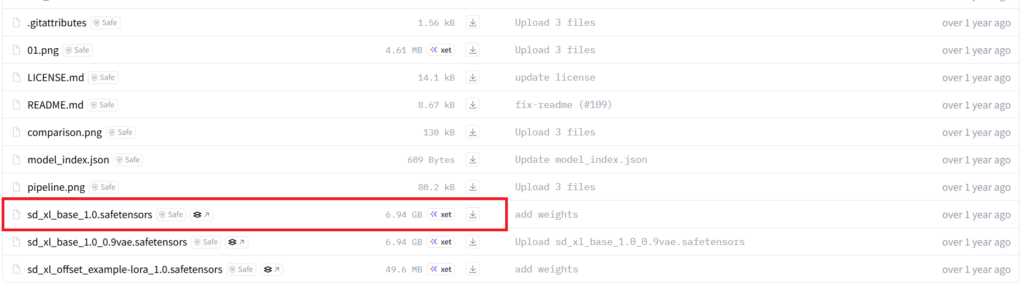

③必要に応じてstable-diffusion-xl-base-1.0から「sd_xl_base_1.0.safetensors」もダウンロード

ダウンロードしたファイルは以下のように配置します。

Checkpointモデル(sdxl_lightning_8step.safetensors): /ComfyUI/models/checkpoints/フォルダ内

LoRAモデル(sdxl_lightning_8step_lora.safetensors): /ComfyUI/models/loras/フォルダ内

Google Colabを使って導入する方法

手元にハイスペックPCがない場合は、Google Colabを使うのも良い選択肢です。

以下にサンプルコードを示します。

import os

!apt -y update -qq

!apt -y install -qq aria2

!pip install -q torch==1.13.1+cu116 torchvision==0.14.1+cu116 torchaudio==0.13.1 torchtext==0.14.1 torchdata==0.5.1 --extra-index-url https://download.pytorch.org/whl/cu116 -U

!pip install -q xformers==0.0.16 triton==2.0.0 -U

!pip install -q mediapipe==0.9.1.0 addict yapf fvcore omegaconf

!git clone https://github.com/comfyanonymous/ComfyUI

%cd /content/ComfyUI

!pip install -q -r requirements.txt

!git reset --hard

!git clone https://github.com/ltdrdata/ComfyUI-Manager /content/ComfyUI/custom_nodes/ComfyUI-Manager

# SDXL BaseモデルとLightningモデルのダウンロード

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/stabilityai/stable-diffusion-xl-base-1.0/resolve/main/sd_xl_base_1.0.safetensors?download=true -d /content/ComfyUI/models/checkpoints -o sdxl_1.0.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/ByteDance/SDXL-Lightning/resolve/main/sdxl_lightning_8step.safetensors?download=true -d /content/ComfyUI/models/checkpoints -o sdxl_lightning_8step.safetensors

!aria2c --console-log-level=error -c -x 16 -s 16 -k 1M https://huggingface.co/ByteDance/SDXL-Lightning/resolve/main/sdxl_lightning_8step_lora.safetensors?download=true -d /content/ComfyUI/models/loras -o sdxl_lightning_8step_lora.safetensors上記のコードを実行することで、Google Colab上にComfyUIと必要なモデルファイルが導入されます。

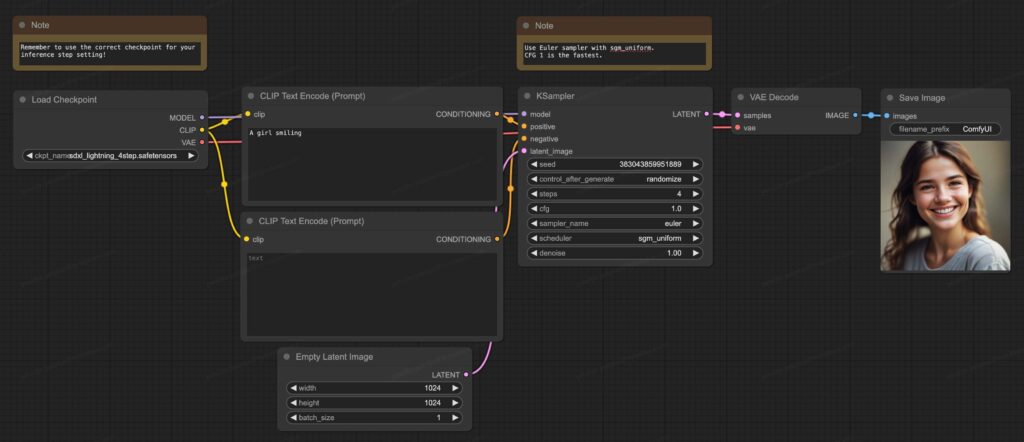

ComfyUIでSDXL Lightningを使う方法

ComfyUIでSDXL Lightningを使うには、まず適切なワークフローファイルが必要です。

以下の手順で進めましょう。

①ByteDance/SDXL-Lightningから「sdxl_lightning_workflow_full.json」と「sdxl_lightning_workflow_lora.json」をダウンロード

②ComfyUIを起動し、ダウンロードしたワークフローファイルをドラッグ&ドロップ

※ComfyUIの詳しい使い方については、下記記事を参考にしてください!

そして、CheckpointとLoRAを使う場合は、下記を開いて使ってみてください!

「sdxl_lightning_workflow_full.json」を使用する場合の設定手順は、以下の通りです。

①「Load Checkpoint」ノードで「sdxl_lightning_8step.safetensors」を選択

②「steps」を「8」に設定(1〜8の範囲で調整可能)

③「cfg」を「1〜3」程度に設定(通常より低め)

④上部の「CLIP Text Encode(Prompt)」にプロンプトを入力

⑤下部の「CLIP Text Encode(Prompt)」にネガティブプロンプトを入力

⑥「Queue Prompt」をクリックして画像生成開始

「sdxl_lightning_workflow_lora.json」を使用する場合の設定手順は、以下の通りです。

- 「Load Checkpoint」ノードで「sdxl_1.0.safetensors」を選択

- 「LoraLoaderModelOnly」ノードで「sdxl_lightning_8step_lora.safetensors」を選択

- 「steps」を「8」に設定

- プロンプトとネガティブプロンプトを入力

- 「Queue Prompt」をクリックして画像生成開始

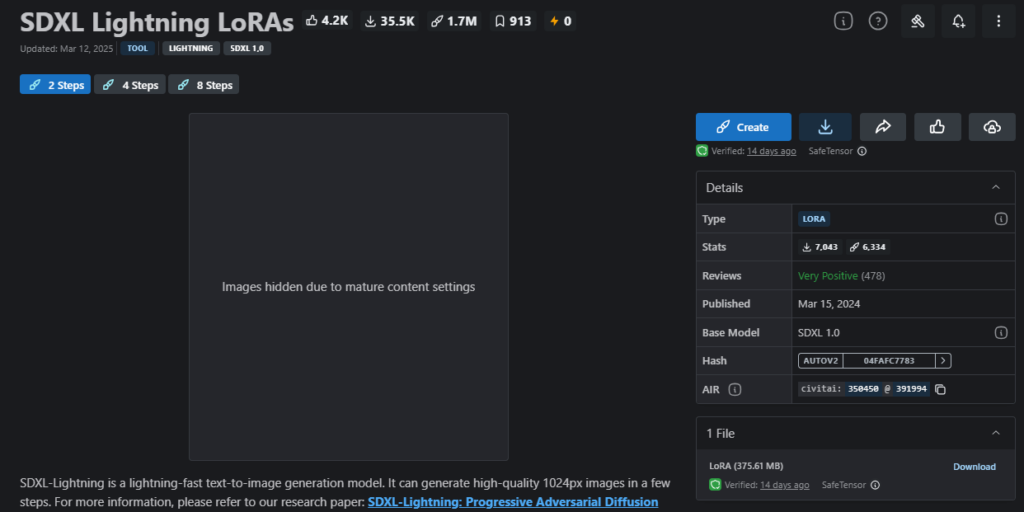

SDXL Lightning LoRAの使い方

SDXL Lightning LoRAの大きな魅力は、他のSDXLモデルと組み合わせて使用できる点です。例えば、Civitaiなどで配布されている好みのSDXLモデルと組み合わせることで、そのモデルの特性を活かしつつ高速化が可能になります。

ComfyUIで使用する場合は、下記のように設定してください。

- ComfyUIに「sdxl_lightning_workflow_lora.json」をロード

- 「Load Checkpoint」ノードで好みのSDXLモデル(例:「blue_pencil-XL」など)を選択

- 「LoraLoaderModelOnly」ノードで「sdxl_lightning_8step_lora.safetensors」を選択

- あとは通常と同じように設定し、「Queue Prompt」で実行

この方法により、お気に入りのモデルの特徴を保ちながら、SDXL Lightningの高速性も獲得できます。

画像生成パラメータの最適設定

SDXL Lightningで最高の結果を得るためには、適切なパラメータ設定が重要です。ここからは、最適な設定を紹介します!

| Step数 | 推奨値:モデル名と同じステップ数(8stepモデルなら8) 許容範囲:1〜8(数値が大きいほど品質が向上) 注意点:1stepモデルは実験段階で品質が低め |

| CFG Scale | 推奨値:1〜3(通常のモデルより低め) 最適値:1.0〜1.5程度 注意点:値が高すぎるとアーティファクトが発生しやすい |

| サンプラー | 推奨サンプラー:Euler、Euler a、DDPM、LCM 最適サンプラー:Euler(公式推奨) 注意点:他のサンプラーでも動作するが、品質に差が出る |

※Stable Diffusionの細かい設定については、下記記事を参考にしてください!

各ステップ数ごとに比較検証してみた!

SDXL Lightningの各ステップ数モデルによる画質の違いを検証してみました。同じプロンプト「Photo of woman in white dress(白いドレスを着た女性の写真)」を使用して比較しています。

①1ステップモデル(実験段階)

1ステップモデルは実験段階とされているため、画質はやや粗い印象です。顔のディテールや服の質感などが不明瞭で、実用には適さない場合が多いでしょう。

②2ステップモデル

2ステップモデルになると画質はかなり上がりますが、細部のディテールや質感表現はまだ完全ではありません。単純な画像なら実用レベルですが、複雑な画像生成には不向きです。

③4ステップモデル

4ステップモデルは画質と速度のバランスが良く、多くの用途で十分なクオリティーのものを生成してくれます。顔のディテールや服の質感もかなり改善され、実用レベルと言えそうです。

④8ステップモデル(最推奨)

8ステップモデルは最も品質が高く、通常のSDXLモデルで20ステップ以上を使った場合に近い品質でした。細部のディテールや質感表現も優れており、ほとんどの用途で満足できる結果が得られるでしょう。

このように、実際に使ってみると、1stepと8stepでは雲泥の差があります。実用的な画質を求めるなら4step以上、こだわりたいなら8stepがベストでしょう。生成時間もほとんど変わらないので、8stepモデル一択と言えます!

SDXL LightningとSDXL Turboとの違い

SDXL LightningとSDXL Turboは、どちらも高速画像生成を目的としたモデルですが、いくつかの違いがあります。

| SDXL Lightning | SDXL Turbo | |

|---|---|---|

| 開発元 | ByteDance(TikTok開発元) | Stability AI(SDXLの開発元) |

| 特徴 | 少ないステップ数(1〜8)で 高品質な画像生成 | 1〜4ステップという 超高速生成に特化 |

| 利点 | 通常のSDXLモデルと 組み合わせて使用可能(LoRA版) | 単独のモデルとして 使用(追加ファイル不要) |

| 推奨ステップ数 | 4〜8ステップ | 1〜2ステップ |

画質については、一般的にSDXL Lightningの方が細部のディテールや質感表現に優れていると言われています。特に8ステップモデルでは、SDXL Turboよりも高い品質を実現できます。

一方、純粋な速度を求める場合はSDXL Turboの方が有利です。用途によって使い分けるのがベストでしょう。

※SDXL Turboについては、下記記事で詳しく解説しています!

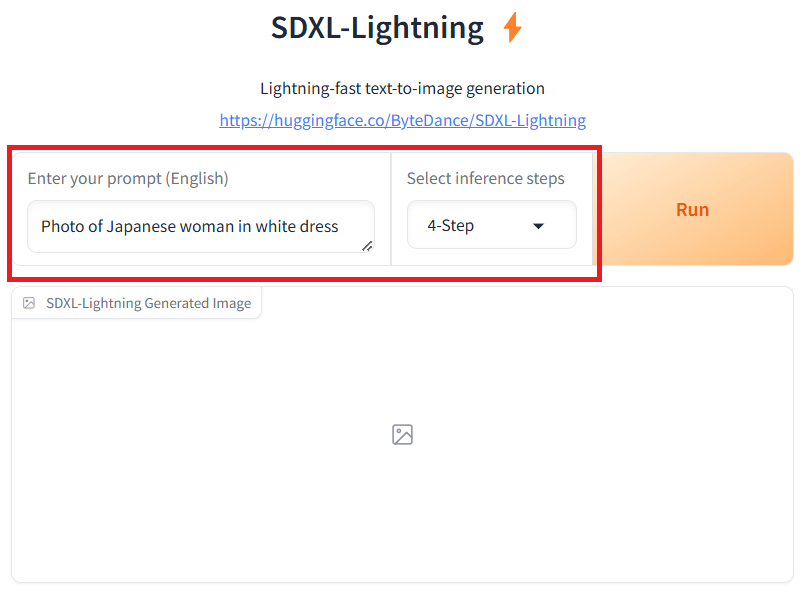

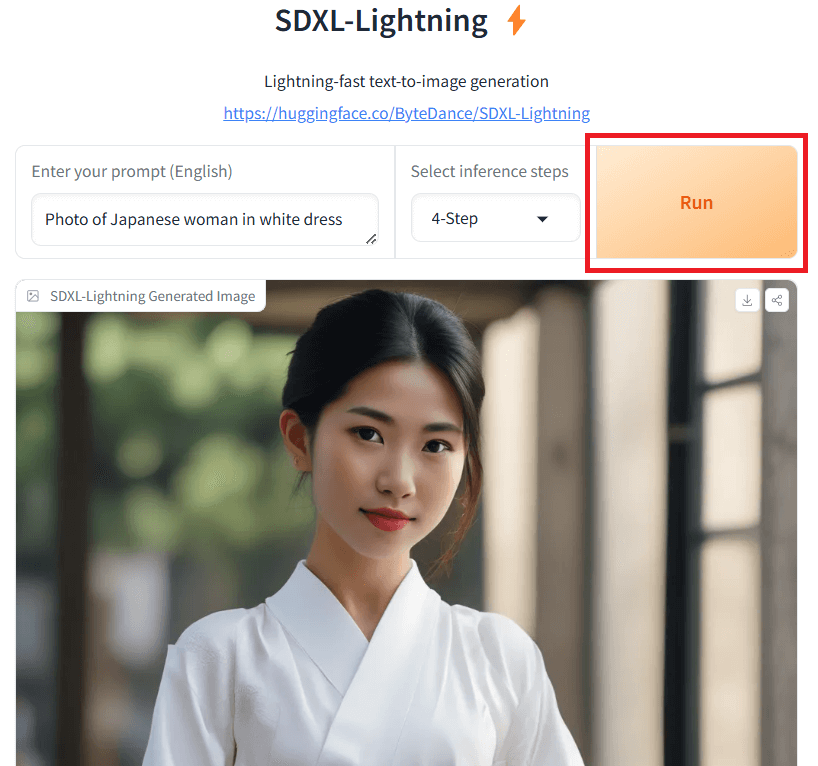

SDXL Lightningをデモ版で簡単に試す方法

SDXL Lightningを手軽に試してみたい場合は、Hugging Face上で公開されているデモ版を利用できます。

デモ版の利用手順は、以下の通りです。

①ByteDance/SDXL-Lightningにアクセス

②「Demo」ボタンをクリック

③テキスト入力欄にプロンプトを入力

④「Select inference steps」でステップ数を選択(1、2、4、8から選択可能)

⑤「Run」ボタンをクリックして画像生成開始

デモ版はComfyUIなどの環境構築が不要で、ブラウザ上で簡単に試せるのが魅力です。ただし、利用者が多い時間帯は処理が遅くなる場合があります。

【FAQ】よくあるエラーと対処法

- Q「CUDA out of memory」というエラーが表示されます。どうすれば解決できますか?

- A

このエラーはGPUのVRAM容量が不足している場合に発生します。以下の対策を試してみてください。

- 生成する画像の解像度を下げる(1024×1024→512×512など)

- SDXL Lightning LoRA版を使用する(通常のモデルよりメモリ消費が少ない)

- 不要なブラウザタブやアプリケーションを閉じてメモリを解放する

- Google ColabやPaperspaceなどのクラウド環境を利用する

- Q画像生成結果の品質が極端に悪いのですが、なぜですか?

- A

サンプラーの設定が不適切な可能性があります。以下を確認してください。

- サンプラーをEulerまたはEuler aに変更する

- CFG値を1〜3の範囲に調整する(特に1.0〜1.5が推奨)

- 適切なステップ数を設定する(8stepモデルには8ステップを使用するなど)

- Q「UNet model not found」や「Model not found」などのエラーが出ます。

- A

モデルファイルが正しく配置されていない場合に発生します。

- モデルファイルが適切なフォルダに配置されているか確認する

- Checkpointモデル →

/ComfyUI/models/checkpoints/ - LoRAモデル →

/ComfyUI/models/loras/

- Checkpointモデル →

- ファイル名が正しいか確認する

- モデルファイルが適切なフォルダに配置されているか確認する

- Qワークフローファイル(.json)をドラッグ&ドロップしても何も起こりません。

- A

この問題にはいくつかの原因が考えられるため、以下の解決策を試してみてください。

- ブラウザの互換性の問題:Chrome/Edgeなど別のブラウザを試す

- ファイルの破損:ワークフローファイルを再ダウンロードする

- ComfyUIのバージョン:最新版にアップデートする

- Q特定の特徴(顔のディテールや髪型など)が思ったように再現されません。

- A

少ないステップ数では細部のディテールが上手く表現されないことがあります。

- ステップ数を増やす(4→8など)

- プロンプトの重みづけを調整する(important:1.2など)

- 必要に応じて追加のLoRA(顔特化LoRAなど)を組み合わせる

- QGoogle Colab上でSDXL Lightningを実行すると「OOM」エラーが発生します。

- A

これは、Google Colabのメモリ制限に関する問題です。

- 無料版ではなくPro/Pro+版を利用する(より多くのVRAMが使用可能)

- 画像サイズを768×768など小さめに設定する

- 画像のバッチサイズを1に設定する

- Qsdxl_lightning_8step_loraをAUTOMATIC1111のWeb UIで使いたいのですが、うまく動きません。

- A

AUTOMATIC1111でLoRAを使用するには以下の設定が必要です。

- AUTOMATIC1111 v1.9以降にアップデートする

- 通常のLoRAと同様にLoRAタブに追加する

- サンプラーをEulerに設定する

- ステップ数を8に、CFG値を1〜3に設定する

- Q生成された画像が毎回同じように見えます。バリエーションが欲しいのですが?

- A

画像のバリエーションを増やすには、以下の対策が有効です。

- シード値をランダムに変更する:参考記事(https://romptn.com/article/4780)

- CFG値を少し調整してみる(1.0→1.5など)

- LoRAの強度を調整する(0.8→1.0など)

まとめ

いかがでしたでしょうか?

SDXL Lightningの基本から導入方法、効果的な使い方まで詳しく解説しました。

この記事で紹介したことをまとめると次のようになります。

- SDXL Lightningは8stepでも高品質な画像が生成できる技術

- サンプラーをEulerに設定するのが最適

- CFG値は1〜3程度の低めの値に設定すると良い結果が得られる

- 通常のモデルもLoRA版も使えるので目的に合わせて使い分ける

AI画像生成の処理時間に悩んでいた方や、より効率良く画像を生成したいという方に、この記事がお役に立てたのではないでしょうか?

ぜひ、SDXL Lightningを導入してみてくださいね!

実際に稼いでいる人の画像生成AIのスキルと収益化方法を知っていますか?

romptn ai が開催する完全無料のAIクリエイターセミナーでは、現場で活躍するプロから下記のような内容を学べます。

- ゼロから画像生成AIで収益化を達成するための具体的なロードマップ

- 実績のある講師が実践する初心者を脱出するための必須スキルと最新ツール

- Nano Banana や Grokなどスマホからでもできる本格的な画像生成AI活用方法

- 広告画像や映像など実際の制作過程をイメージするための講師によるライブデモ

2時間のオンラインセミナーで、ただ画像生成AIや動画生成AIの上級スキルや最新ツールを知るだけでなく、実際に収益化を達成する一歩を踏み出すための必須知識を学ぶことができます。

- 大手企業6社と契約実績(TOYOTA, mercari, 伊藤園 等)

- AI映画制作3本、WORLD AI FILM FESTIVAL 2026 in KYOTO にて2冠達成

- Best AI Anime 受賞

- Japan Best AI Film(グランプリ)受賞(応募431作品中)

- 経歴:元WEBデザイナー・マーケター → 2023年に生成AIと出会い転身 → プロのAIクリエイターへ